MLCommons รายงานผลทดสอบ MLPerf Inference benchmark ฉบับล่าสุด ประกอบด้วยผลทดสอบมากกว่า 5,300 รายการ

MLCommons สมาคมพัฒนาทางด้าน Open-source AI ออกรายงานผลทดสอบ MLPerf Inference Benchmark เวอร์ชัน 2.1 เป็นที่เรียบร้อย โดยเป็นการทดสอบการทำงานของฮาร์ดแวร์ในระดับ Datacenter และ Edge เมื่อนำมาใช้งานกับการทำ Inference ในระบบ AI ซึ่งเป็นขั้นตอนการทำงานของ AI Model หลังจากที่ผ่านการเทรนเรียบร้อยแล้ว เพื่อเป็นแนวทางให้ผู้ใช้งานสามารถเลือกใช้งานฮาร์ดแวร์ที่เหมาะสมกับงาน AI ได้

MLCommons ได้ทำการรวบรวมผลจากผู้เข้าร่วมหลายรายมากกว่า 20 บริษัท เช่น Alibaba, ASUSTeK, Azure, Biren, Dell, Fujitsu, GIGABYTE, H3C, HPE, Inspur, Intel, Krai, Lenovo, Moffett, Nettrix, Neural Magic, NVIDIA, OctoML, Qualcomm Technologies, Inc., SAPEON, และ Supermicro ทำให้มีผลการทดสอบในรอบนี้กว่า 5,300 รายการ เพิ่มขึ้นจากรอบก่อน 37% นอกจากนี้ยังมีผลการทดสอบการใช้พลังงานอีกกว่า 2,400 รายการ

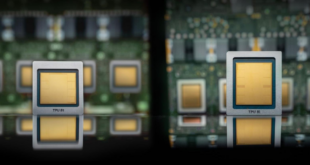

NVIDIA H100 GPU ที่ใช้สถาปัตยกรรม Hopper ยังคงเป็นผู้นำในด้านประสิทธิภาพการทำ AI Inference ซึ่งมีประสิทธิภาพสูงกว่า 4.5 เท่า เมื่อเทียบกับ GPU รุ่นก่อนที่ใช้สถาปัตยกรรม Ampere และติดอันดับโลกในการทดสอบ Inference กับ Workload ทุกรูปแบบ

ที่มา: https://siliconangle.com/2022/09/08/mlcommons-releases-results-latest-ai-inference-benchmark-test/

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย