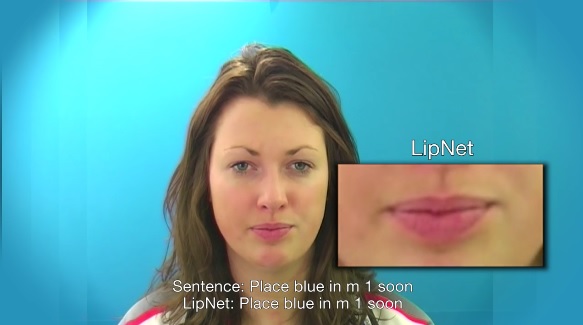

ทีมนักวิจัยจาก University of Oxford ได้ประสบความสำเร็จในการพัฒนาเทคโนโลยีการอ่านปากด้วย Deep Learning ด้วยความแม่นยำที่สูงถึง 93.4% ต่างจากความแม่นยำของมนุษย์ที่มีเพียง 52.3% เท่านั้น

โครงการนี้เริ่มต้นโดยการนำข้อมูลจาก GRID http://scitation.aip.org/content/asa/journal/jasa/120/5/10.1121/1.2229005 ซึ่งได้รวบรวมวิดีโอการพูดประโยคความยาว 3 วินาทีที่ฟังไม่เข้าใจนับหมื่นรูปแบบจากอาสาสมัคร 34 คนเอาไว้พร้อมคำบรรยายประกอบ โดยแต่ละประโยคนั้นจะประกอบไปด้วย คำสั่ง สี คำบุพบท ตัวอักษร ตัวเลข และคำขยายกิริยา

ปัจจุบันความแม่นยำระดับนี้ยังคงทำได้เฉพาะกับข้อมูลจำกัดเหล่านี้เท่านั้น แต่ทีมวิจัยก็มองในแง่ดีว่าถึงแม้จะมีข้อมูลจำกัดระบบ AI ก็ยังสามารถเรียนรู้ได้ดี หากมีข้อมูลมากกว่านี้ระบบ AI จะต้องแม่นำยิ่งขึ้นกว่าเดิมแน่นอน

เทคโนโลยีนี้มีความเป็นไปได้ที่จะถูกนำไปใช้ผู้ที่บกพร่องทางการฟังให้สามารถทราบได้ว่าคู่สนทนากำลังพูดถึงเรื่องอะไรอยู่ในที่ที่มีเสียงดัง

สำหรับความเป็นไปได้ที่ความสามารถนี้จะถูกนำไปรวมอยู่บนอุปกรณ์ CCTV เพื่อตรวจสอบว่าใครพูดอะไรกันบ้างนั้นถือว่ายังต่ำอยู่ เพราะเทคโนโลยีนี้จำเป็นต้องเห็นลิ้นของผู้พูดด้วย ทำให้ต้องอาศัยกล้องคุณภาพดีและถ่ายจากหน้าตรงเท่านั้น ซึ่งถ้าหากจะทำถึงระดับนั้นการติดตั้งไมโครโฟนก็ดูจะเป็นทางออกที่ง่ายกว่าในการดักฟัง

ผู้ที่สนใจสามารถอ่านงานวิจัยฉบับเต็มได้ที่ http://www.oxml.co.uk/publications/2016-Assael_Shillingford_LipNet.pdf เลยนะครับ

ที่มา: http://www.theverge.com/2016/11/7/13551210/ai-deep-learning-lip-reading-accuracy-oxford

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย