ปัจจุบัน Generative AI ไม่ได้เป็นแค่ความตื่นตาตื่นใจสำหรับบุคคลทั่วไป แต่ยังเป็นเป้าหมายขององค์กรด้วยเช่นกัน เพื่อยกระดับประสบการณ์ในงานใช้งาน อนึ่งนอกจากความท้าทายด้านข้อมูลและการพัฒนาโมเดลเพื่อแก้โจทย์ทางธุรกิจแล้ว การใช้งานในภาคองค์กรยังมีความท้าทายหลายด้านรออยู่ เช่น การทำงานในสภาพแวดล้อมแบบ Hybrid Cloud การขยายตัวรองรับ Workload ที่อาจจะเพิ่มขึ้นในอนาคต ความปลอดภัยของตัวโมเดล AI หรือความขัดแย้งกับระเบียบข้อบังคับขององค์กร ไปจนถึงมุมมองด้านการเลือกเครื่องมือที่มีในท้องตลาดมากมาย

ด้วยเหตุนี้เอง Red Hat OpenShift AI Roadshow 2024 จึงเป็นโอกาสอันดีที่ผู้เข้าร่วมทุกท่านจะได้ทราบถึงโซลูชันจาก Red Hat ที่พร้อมรองรับโปรเจ็กต์ AI ได้อย่างครบวงจร โดยทีมงาน TechTalkThai ขอเรียบเรียงประเด็นสำคัญมาให้ทุกท่านติดตามได้ในบทความนี้

โปรเจ็กต์ AI ในองค์กรเกี่ยวข้องกับทุกหน้าที่

“หากวิเคราะห์ถึงการประยุกต์ใช้ AI ในภาคธุรกิจจะเห็นได้ว่าเทคโนโลยีทางไอทีนี้ถูกขับเคลื่อนมาจากความต้องการทางธุรกิจอย่างแท้จริง เพราะเป็นที่ประจักษ์ชัดต่อโลกแล้วว่า AI สามารถช่วยพลิกเกมธุรกิจให้เติบโตขึ้น มีผลกำไรมากขึ้น หรือบรรเทาความเสี่ยงจากการละเมิด Policy และการเข้าถึงข้อมูลโดยมิชอบ” — คุณ Piyanant Siridej, OpenShift Sales Specialist จาก Red Hat ได้กล่าวถึงเกี่ยวกับแรงขับเคลื่อนของ AI ให้ผู้ชมได้เห็นภาพว่า AI คือปัจจัยที่สำคัญต่อธุรกิจโดยตรง ไม่ใช่แค่เพียงเทคโนโลยีหนึ่งๆ แต่คือการเข้ามาเพื่อแก้ปัญหาบางอย่างทางธุรกิจ

ความท้าทายของการสร้าง AI เพื่อใช้งานในองค์กรนั้นมีประเด็นเกี่ยวกับความท้าทายอยู่หลายด้าน ประการแรก คือองค์กรต้องเตรียมข้อมูลที่มีคุณภาพซึ่งหัวข้อนี่ถูกพูดถึงมาโดยตลอดเกี่ยวกับโครงการ AI ที่มักพบเห็นได้ทั่วไปในระดับองค์กร กล่าวคือต้องเตรียมมีข้อมูลที่ถูกต้อง และสามารถบูรณาการข้อมูลจากแหล่งต่างๆในองค์กร

ประการที่สอง องค์กรต้องวางแนวทางของโปรเจ็กต์ AI ให้สอดคล้องต่อระเบียบข้อบังคับขององค์กรด้วยว่าจะมีการใช้งานอย่างไร และมีการแบ่งหน้าที่ความรับผิดชอบและวางตัวผู้เกี่ยวข้องอย่างชัดเจน ตลอดจนการมีเครื่องมือที่ดีในการทำหน้าที่นั้น ภายในกรอบปฏิบัติที่เกี่ยวกับอุตสาหกรรมหรือมีกระบวนการที่กำกับดูแลการใช้งานตามมาตรฐานสากล เช่น HIPAA, GDPR หรือ NIST

ประการที่สาม คือเรื่องความมั่นคงปลอดภัยทั้งส่วนของโครงสร้างพื้นฐานและข้อมูล ในส่วนโครงสร้างพื้นฐาน การตั้งค่าในคลาวด์มักนำไปสู่ปัญหาของข้อมูลรั่วไหล หรือการตรวจสอบองค์ประกอบที่นำเข้าจาก Third-party ก็สำคัญอย่างยิ่ง ทั้งนี้การใช้งานในองค์กรยังต้องคำนึงถึงความปลอดภัยและความละเอียดอ่อนของข้อมูลที่ต้องไม่ถูกเข้าถึงโดยมิชอบ

ประการที่สุดท้าย คือประเด็นเรื่องของการพัฒนาโมเดล AI เพื่อใช้งาน สำหรับการใช้งานในองค์กรที่ถูกขับเคลื่อนโดยโจทย์ทางธุรกิจนั้น มักต้องถูกตรวจสอบโดยบุคคลอื่นที่ไม่ได้มีบทบาทโดยตรง ซึ่งต้องทำให้แน่ใจว่าโมเดล AI ที่ถูกพัฒนาขึ้นดีพอต่อการนำไปใช้งานจริง

อนึ่งในทางปฏิบัตินั้นเส้นทางของการพัฒนา AI ไม่ได้จบลงเพียงแค่ว่าองค์กรมีโมเดลขึ้นใช้งาน เพราะการที่จะพัฒนาโมเดล AI นั้นต้องประกอบด้วยทีม Data Scientist และ Business Analyst เพื่อนำส่งแก่ทีมธุรกิจและบริหารจัดการโดยผ่านกระบวนการด้าน MLOps ซึ่งจะเห็นได้ว่างานการพัฒนาโมเดลเป็นแค่จุดกำเนิดเริ่มต้นเท่านั้น แต่ที่น่าสนใจคือจะทำอย่างไรที่จะดูแลและจัดการโครงสร้างพื้นฐาน รวมถึง deploy โปรเจ็คได้ในทุกสภาพแวดล้อม พร้อมขยายตัวรองรับการทำงานเพิ่มเติมได้ นั่นต่างหากคือความท้าทายที่แท้จริงของความสำเร็จในภาคองค์กร

เติบโตอย่างไร้ขีดจำกัดด้วย Red Hat OpenShift AI

“การพัฒนา AI ในองค์กรเป็นเรื่องที่ใหญ่กว่า Local Enviroment แต่คือการบูรณาการระหว่างทุกฝ่าย และที่สำคัญเมื่อโมเดลเป็นรูปเป็นร่างแล้วต้องสามารถขยายตัวรองรับการเติบโตที่รออยู่ข้างหน้าได้ โดยปัจจุบันนี้เราได้เล็งเห็นแล้วว่าโปรเจ็กต์ AI มักจะใช้โมเดลมากกว่า 1 ตัว ซึ่ง Red Hat เราได้นำเสนอโซลูชันที่เปิดให้องค์กรทดสอบเริ่มต้นได้ Local Environment จนถึงระดับการใช้งานใน Production และเพิ่มประสิทธิภาพได้มากขึ้นอย่างยืดหยุ่นด้วย Red Hat OpenShift AI ที่มาพร้อมกับเครื่องมือที่จำเป็นในหน้าที่ต่างๆอย่างครบวงจร” ใจความสำคัญในหัวข้อ Oprationalize AI with Red Hat Openshift AI ที่บรรยายโดย คุณ Li Ming, AI Architect, Asia Pacific จาก Red Hat

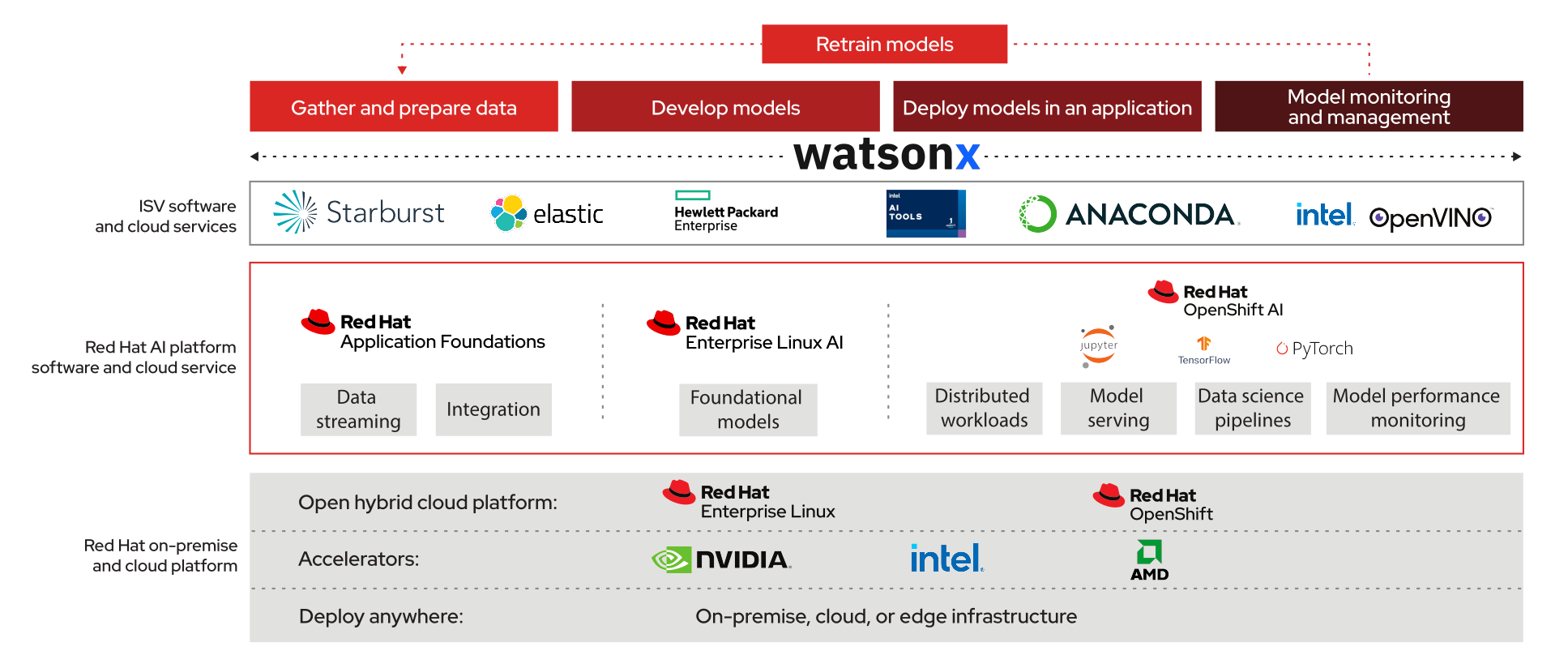

ใจความสำคัญของ Red Hat OpenShift AI คือการต่อยอดพื้นฐานใน Red Hat OpenShift ให้มีเครื่องมือที่พร้อมสำหรับวงจรการพัฒนาโมเดล AI ได้อย่างครบเครื่อง ซึ่งในโลกความเป็นจริงแล้วต้องยอมรับว่าเครื่องมือเหล่านี้ถูกนำเสนอแก่ตลาดจนแทบไม่สามารถหาข้อสรุปได้ว่าควรเลือกใช้เครื่องมือใด

โดยในมุมของ Red Hatที่เป็นผู้นำด้านโซลูชันโอเพ่นซอร์สได้เตรียมการเครื่องมือที่น่าเชื่อถือและได้รับการพิสูจน์แล้วว่าจำเป็นต่อการพัฒนาโปรเจ็กต์ AI มาให้อย่างครบครัน เช่น InstructLab ที่ช่วยในการเข้าถึงโมเดล LLM และ Granite Model ที่เป็น Open Source Foundation AI Model ภายใต้สนธิสัญญา Apache 2 ซึ่งใช้ข้อมูลที่ถูกตามลิขสิทธิ์มาเทรนโมเดลพร้อมใช้ได้ตตั้งแต่แง่มุมของ Code Model, Time Series Model, Language Model และ Geospatial Model นอกจากนี้ยังมี Podman Desktop ที่ช่วยในการบริหารจัดการ Container โดยทั้งหมดนี้ได้ถูกนำมาสาธิตและใช้งานในช่วง Workshop ที่ทำให้ผู้เข้าร่วมได้เข้าใจว่าการพัฒนา Generative AI สามารถทดลองได้ในเครื่องเพียงเครื่องเดียว นอกจากนี้ Red Hat OpenShift AI ยังมีเครื่องมือโอเพ่นซอร์สอื่นๆที่จำเป็นต่อการพัฒนาโมเดลเช่น Open Data Hub, Jupyter, Pytorch และ Kubeflow

ในมุมของ Infrastructure เรียกได้ว่า Red Hat ถือเป็นแพลตฟอร์มกลางที่รวบรวมเครื่องมือสำหรับการพัฒนาแอปพลิเคชันมาให้แล้ว เช่น Apache Kafka สำหรับงานรองรับข้อมูล Real-time และ Event Streaming ไปจนถึง 3scale สำหรับการจัดการเรื่อง API และแน่นอนว่านี่เป็นเพียงเครื่องมือเพียงส่วนเดียวที่ถูกหยิบยกขึ้นมาเท่านั้น

โครงการ AI ยังต้องคำนึงถึงฮาร์ดแวร์และเทคโนโลยีเฉพาะของค่ายต่างๆด้วย ซึ่งแน่นอนว่า NVidia คือผู้นำในตลาด GPU รายใหญ่ที่ได้รับความนิยม ทั้งนี้ผู้เล่นชั้นนำในตลาดชิปประมวลผลต่างมีความโดดเด่นทางเทคโนโลยีของตนซึ่ง Red Hat OpenShift AI พร้อมทำงานรองรับทุกค่าย เช่น NVidia, Intel และ AMD เป็นต้น เพราะปัจจุบัน GPU หรือ Accelerator ได้กลายเป็นหัวใจที่ขับเคลื่อนประสิทธิภาพของงาน AI ไปแล้ว

อย่างไรก็ดีเมื่อองค์กรได้อนุมัติโมเดล AI ที่พร้อมใช้งานแล้ว ในการใช้จริงองค์กรมักต้องคำนึงถึงการขยายตัวและการทำงานในรูปแบบของ Hybrid และ Multi-cloud ด้วย ซึ่งความเป็น Container-based จาก OpenShift จะช่วยให้องค์กรสามารถเพิ่มขนาดของ Workload เพื่อทำงานร่วมกันและจัดการทุกสภาพแวดล้อมได้จากเครื่องมือเดียวกัน โดยสามารถเลือก Deploy โมเดลบน Red Hat Enterprise Linux, Public Cloud หรือแพลตฟอร์มอื่นๆได้ง่ายดาย ที่สำคัญคือการจัดการทรัพยากรบนแพลตฟอร์ม Red Hat ได้เปิดให้ทีมงาน DevOps หรือ Data Scientist สามารถเปิดใช้ทรัพยากรได้ด้วยตัวเองสอดคล้องกับโจทย์ด้านความเร็วในการพัฒนา โดยไม่ต้องรวมศูนย์อำนาจทุกอย่างไว้ที่แอดมินเหมือนในอดีต

นอกจากนี้ Red Hat ยังมีความร่วมมือกับพันธมิตรต่างๆ เพื่อสร้างมาตรฐานด้านความมั่นคงปลอดภัยในโลกของ AI ที่ปัจจุบันยังไม่มีความชัดเจนมากนัก แต่ Red Hat ได้เริ่มเตรียมแนวทางในอนาคตเกี่ยวกับเครื่องมือโอเพ่นซอร์ส TrustyAI ที่เป็นความหวังในด้านความรับผิดชอบในการใช้งาน AI อย่างมีจริยธรรม อธิบายได้ และ มีการติดตามการใช้ข้อมูลและ Prompt โดยคาดว่าจะทำงานภายใน Open Data Hub และ Red Hat OpenShift AI ตลอดจนการจัดการโมเดลต่างๆในงาน AI ผ่านสิ่งที่เรียกว่า Model Registry ด้วย

ถอดบทเรียน : การใช้งานจริงของ Red Hat OpenShift AI ในอุตสาหกรรมต่างๆ

ภายในงานสัมมนาครั้งได้มีการหยิบยกความร่วมมือระหว่าง Red Hat และธุรกิจองค์กรต่างๆ ที่ Red Hat สามารถเข้าไปช่วยในโครงการ AI โดยมีกรณีศึกษาดังนี้

● โรงพยาบาลเด็กบอสตัน – โจทย์ของโรงพยาบาลคือเดิมทีพวกเขาต้องใช้เวลาอย่างมากไปกับการวิเคราะห์ภาพพัฒนาการทางสมองและการเคลื่อนไหวแขนขาเพื่อวิเคราะห์ว่าเด็กในครรภ์มีความผิดปกติหรือไม่ ด้วยเหตุนี้เอง AI จึงสามารถเข้ามาช่วยงานของพวกเขาผ่านทาง Red Hat OpenShift AI เพื่อแปรผลภาพฟิล์มได้อย่างอัตโนมัติจากเดิมที่ต้องใช้เวลาถึง 2 ชั่วโมงเหลือเพียง 2 นาที โดยโรงพยาบาลยังได้แบ่งปันนวัตกรรมนี้ให้แก่ศูนย์ศึกษาอื่นผ่านคลาวด์โดยหวังว่าจะเป็นประโยชน์ให้แก่การรักษาในวงกว้าง

● AIRBUS helicoptors – ส่วนธุรกิจของ AIRBUS นี้ไม่ใช่เครื่องบินอย่างที่คุ้นเคย โดยแม้พวกเขามีทีม Data Scientist หลายทีมที่มีแพลตฟอร์มเป็นของตัวเองแต่ปัญหาคือไม่สามารถบูรณาการการทำงานร่วมกันได้เพราะขาดการจัดการจากศูนย์กลาง ซึ่ง Red Hat คือคำตอบที่ช่วยแก้ปัญหาให้แต่ละทีมในโปรเจ็กต์ AI สามารถสนับสนุนงานในโปรเจ็กต์ได้แต่ไร้รอยต่อในการทำงาน

● สายการบินระดับสากลระดับ Top 10 (ไม่เปิดเผยชื่อแบรนด์) – ในกลุ่มธุรกิจสายการบินมีโจทย์หลายส่วนเกิดขึ้นทั้งมุมของการติดตามสุขภาพของระบบ การกำหนดราคาค่าโดยสาร การตลาดเพื่อขยายฐานลูกค้าหรือรักษาฐานเดิม ตลอดจนการวิเคราะห์ความพยายามปลอมแปลงต่างๆ โดยภาพรวมก็คือ Red Hat เข้าไปช่วยธุรกิจของพวกเขาเพื่อนำส่ง MLOps Practice เข้าไปในกระบวนการ

● สถาบันการเงินขนาดใหญ่ในจีน – ลูกค้าต้องการยกระดับต่อยอดจาก OpenShift สู่งาน AI โดยหวังมีระบบแนะนำเกี่ยวกับการโค้ดตั้งแต่การรวมโค้ดไปจนถึงขั้นตอนการเขียนโค้ด ที่เหมือนมีแชตบอทสอบถามได้ง่ายๆ ซึ่งต้องมีการใช้งาน LLM หลายโมเดลร่วมกัน ทั้งนี้โปรเจ็กต์ยังถูกจำกัดด้วยทรัพยากร GPU ที่มี ดังนั้นต้องมีการปรับจูนเรื่องของประสิทธิภาพร่วมด้วย โดย Red Hat OpenShift AI ได้เข้าไปตอบโจทย์ปัญหาของธุรกิจพร้อมทำให้การพัฒนา AI อยู่ภายในกระบวนการ CI/CD ได้อย่างไร้รอยต่อ

สนับสนุนการเติบโตของ AI ในธุรกิจด้วยบริการดูแลอย่างครบวงจรจาก Red Hat

การพัฒนาโปรเจ็กต์ AI เป็นที่ต้องอาศัยทั้งทักษะและประสบการณ์ แต่ด้วยความที่ AI ถือเป็นเทคโนโลยีใหม่สำหรับหลายองค์กร ดังนั้นการมีผู้เชี่ยวชาญที่สามารถให้คำแนะนำพร้อมสนับสนุนทุกย่างก้าวจึงเป็นเรื่องที่จำเป็น ทั้งนี้ Red Hat ได้นำเสนอการสนับสนุนโปรเจ็กต์ AI แก่ภาคองค์กรได้ในหลายบทบาท เช่น มีการจัดตั้งคอร์สเรียนเพื่อพัฒนาทักษะบุคคลากรให้มีความพร้อมในความรู้ รวมถึงบริการให้คำปรึกษาจากผู้เชี่ยวชาญ

อย่างไรก็ดีคุณ Veerat Chakmasu, Associate Manager, Consulting Services จาก Red Hat ได้เน้นย้ำถึงวิสัยทัศน์ของ Red Hat ที่มุ่งมั่นสร้างความช่วยเหลืออย่างยั่งยืน โดยมีการสนับสนุนองค์กรแบบครบวงจรตั้งแต่เริ่มต้นเพื่อสุดท้ายแล้ว องค์กรจะสามารถดูแลโปรเจ็กต์ได้ด้วยตนเอง ทั้งนี้ขั้นตอนจะเริ่มต้น Red Hat จะเข้าไปประเมินปัจจัยปัจจุบันขององค์กรทั้งด้านเทคนิค กรณีศึกษาและโจทย์ทางธุรกิจสำหรับ AI ตลอดจนเทคโนโลยีที่มี เมื่อผ่านการประเมินแล้ว Red Hat จะเป็นให้คำปรึกษาและช่วยเหลือองค์กรเกี่ยวกับการประยุกต์ใช้ Best Practice พร้อมปรับจูนโมเดล AI เพื่อตอบโจทย์ทางธุรกิจ ตามด้วยการเริ่มต้นระบบ Red Hat OpenShift AI พร้อมปิดท้ายด้วยการวาง MLOps Workflow

บทส่งท้าย

ในงานครั้งนี้ทีมงาน Red Hat ได้ชี้ให้ผู้เข้าร่วมได้เห็นว่าแพลตฟอร์มของตนมีการต่อยอดอย่างเป็นขั้นเป็นตอนเริ่มต้นตั้งแต่ Red Hat Enterprise Linux และ Red Hat OpenShift ที่รองรับความเป็น Hybrid Cloud และสุดท้ายคือการต่อยอดอย่างเฉพาะทางด้วย Red Hat OpenShift AI ที่มีเครื่องมือในการพัฒนาโครงการ AI อย่างครบวงจร อย่างไรก็ดีภายในงานได้เน้น AI ในหัวข้อ Generative AI เป็นสำคัญ โดยทุกคนสามารถเริ่มต้นได้ง่ายๆในเครื่องตัวเองผ่าน Podman Desktop ร่วมกับ InstructLab และโอเพ่นซอร์ส Granite โมเดล LLM ที่ทรงประสิทธิภาพที่ช่วยปรับปรุงโมเดลเหมาะสำหรับงานในองค์กร รวมไปถึงกรณีศึกษาส่วนหนึ่งจาก Red Hat ที่เข้าไปช่วยงานโปรเจ็กต์ AI ในธุรกิจต่างๆ

ช่วงบ่ายผู้เข้าร่วมทุกท่านได้ลงมือทดลองจริงตามสถานการณ์สมมติจากช่วงสาธิตในตอนเช้า โดยเป็นแลปที่ให้ทุกท่านได้สัมผัสกับการใช้ Podman Desktop และ InstructLab เพื่อพัฒนาแชทบอตที่อาศัยโมเดล LLM ประยุกต์เข้ากับข้อมูลเฉพาะในการเคลมประกันอุบัติเหตุรถยนต์

โดยสรุปแล้วใจความสำคัญก็คือ Red Hat พร้อมสำหรับการเป็นรากฐานของโปรเจ็กต์ AI ระดับองค์กรที่เปิดกว้างสำหรับทุกแพลตฟอร์มและสภาพแวดล้อมแบบ Hybrid Cloud โดยมีเครื่องมือที่จำเป็นต่อทุกฝ่ายในโปรเจ็กต์ทั้ง Data Scientist, MLOps, DevOps และผู้ดูแลระบบ Infrastructure พร้อมรองรับการขยายตัวได้อย่างไร้รอยต่อ และนั่นคือไฮไลต์ในงาน Red Hat OpenShift AI Roadshow 2024

สนใจโซลูชันของ Red Hat สามารถติดต่อกับทีมงานได้ที่ Red Hat Thailand

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย