ปี 2023 ถือได้ว่าเป็นปีแห่ง “Generative AI” โดยแท้จริง ตั้งแต่การผงาดขึ้นมาของ ChatGPT กระแสของ Generative AI ก็ร้อนแรงขึ้นมาอย่างมหาศาล โมเดล GPT สารพัดรูปแบบเกิดขึ้นมาจนทำให้แทบทุกมุมโลกต้องพูดถึงเรื่องนี้ ซึ่งสิ่งที่เกิดขึ้นได้ทำให้ทั้งโลกต้องการ “หน่วยประมวลผล” ที่ทรงพลังยิ่งกว่าที่ผ่านมา เพื่อรองรับความต้องการ AI Workload ที่ทวีคูณขึ้นอย่างที่ไม่เคยมีมาก่อน

ด้วยความต้องการที่เกิดขึ้น ทาง AMD จึงได้จัดงาน “AMD Advancing AI” เมื่อสัปดาห์ก่อน เพื่อเปิดตัวผลิตภัณฑ์หน่วยประมวลผลใหม่ออกมาในทุกระดับตั้งแต่ Enterprise ไปจนถึง Consumer ที่พร้อมตอบโจทย์ Workload ยุคใหม่อย่าง Generative AI ภายใน Cloud หรือ Data Center ไปจนถึง Endpoint บนเครื่อง AI PC อีกทั้งยังมีซอฟต์แวร์สนับสนุนให้การทำงานบนอุปกรณ์ AMD มีประสิทธิภาพสูงขึ้น และสนับสนุนนักพัฒนาระบบสร้างแอป Generative AI ได้ง่ายขึ้นกว่าเดิมอีก ภายในงานนี้ AMD มาเปิดตัวอะไรบ้าง สรุปรวมไว้แล้วในบทความนี้

AI คือ “อนาคตของการประมวลผล”

คำว่า “Artificial Intelligence” หรือ AI ที่เป็นกระแสอยู่ ณ ตอนนี้ แท้จริงแล้วได้กำเนิดขึ้นมาโดย John McCarthy ตั้งแต่ปี 1956 แล้ว หากแต่หลังจากวิวัฒนาการของเทคโนโลยีต่าง ๆ ที่มาบรรจบกันในช่วงไม่กี่ปีที่ผ่านมา ไม่ว่าจะเป็นอินเทอร์เน็ตที่ทำให้สามารถเข้าถึงข้อมูลได้อย่างไร้พรมแดน โซเชียลมีเดียที่ทำให้ข้อมูลเกิดขึ้นอย่างมหาศาล และหน่วยประมวลผลรูปแบบต่าง ๆ ที่ทรงพลังมากขึ้น จนเพียงพอที่ทำให้สามารถปลดล็อกศักยภาพ AI ได้อย่างมีนัยสำคัญในช่วงไม่กี่ปีที่ผ่านมานี้ ดังที่เห็นการใช้งาน AI ในวงกว้างที่สามารถทดแทนแรงงานมนุษย์ได้ในหลาย ๆ งานแล้วในวันนี้

แม้ว่าปัจจุบัน AI อาจจะเรียกได้ว่าอยู่แทบทุกที่ทุกแห่งแล้วก็ตาม ไม่ว่าจะเป็นระบบผู้ช่วยบนโทรศัพท์สมาร์ตโฟน ระบบวิเคราะห์ข้อมูลตามเครื่องมือต่าง ๆ หรือแม้แต่ในหุ่นยนต์ (Robotics) ตามโรงงานอุตสาหกรรม หรือว่าการแพทย์ (Healthcare) ฯลฯ แต่ด้วยวิวัฒนาการ Generative AI ภายในช่วงปีที่ผ่านมาก็ได้ทำให้ “วิธีการทำงาน” ของโลกดิจิทัลแทบจะดิสรัปพลิกโฉมกันไปทั้งหมดอีกครั้ง

และจากการผงาดขึ้นมาของ Generative AI แบบต่าง ๆ ทั้งโลกจึงล้วนต้องการโครงสร้างพื้นฐาน (Infrastructure) ในการประมวลผลแบบใหม่ พร้อมเครื่องมือรูปแบบใหม่ ๆ เพื่อตอบสนองความต้องการในการสร้างหรือว่าพัฒนาแอปพลิเคชันที่ใช้ประโยชน์จาก Generative AI อันเป็นเทคโนโลยีที่กำลังร้อนแรง ณ ตอนนี้ และนี่คือสิ่งสะท้อนให้เห็นถึงแนวคิดของ Dr. Lisa Su ประธานและ CEO แห่ง AMD ที่ได้กล่าวไว้ว่า “AI คืออนาคตแห่งการประมวลผล (Future of Computing)” นั่นเอง

“เพียงระยะเวลาสั้น ๆ เท่านั้น เทคโนโลยี AI ไม่ใช่แค่มีความก้าวหน้าเท่านั้น แต่จริง ๆ แล้วคือแทบจะพุ่งทะยานขึ้นไปเลย ซึ่งปีนี้ได้แสดงให้เห็นแล้วว่า AI ไม่ใช่สิ่งใหม่ที่ทำให้รู้สึกดูเท่ห์เท่านั้น แต่แท้จริงแล้วมันคืออนาคตแห่งการประมวลผล (Future of Computing)” Dr. Lisa Su ประธานและ CEO แห่ง AMD กล่าวภายในงาน AMD Advancing AI ที่ผ่านมา “บางที สิ่งเดียวที่อาจดูใกล้เคียงกับปรากฏการณ์ที่เกิดขึ้นนี้คือการเปิดตัวของโลกอินเทอร์เน็ต แต่สิ่งที่ทำให้ AI แตกต่างคืออัตราการปรับใช้ (Adoption Rate) ที่เร็วกว่ามาก ๆ และแม้ว่าจะมีหลายสิ่งเกิดขึ้นมากมาย แต่ความจริงแล้วตอนนี้ พวกเรายังเพิ่งอยู่ในช่วงเริ่มต้นของยุค AI เท่านั้น”

Generative AI มา ตลาด Data Center ยิ่งเติบโตเร็วขึ้นกว่าเดิม

ในปีก่อนหน้านี้ AMD ได้คาดการณ์ไว้ว่าตลาด Data Center AI Accelerator น่าจะเติบโตขึ้นราว ๆ 50% เป็นประจำทุกปีภายในช่วง 2-3 ปีข้างหน้า ซึ่งอาจจะเติบโตจากมูลค่าราว ๆ 30,000 ล้านดอลลาร์สหรัฐไปสู่มากกว่า 150,000 ล้านดอลลาร์สหรัฐได้ภายในปี 2027

แม้ว่าตัวเลขจะดูสูงมาก ๆ อยู่แล้ว แต่ดูเหมือนว่าความต้องการและการปรับใช้งานนั้นเติบโตขึ้นอย่างมหาศาลมาก ๆ แบบก้าวกระโดด จนทำให้ AMD ปรับการคาดการณ์ว่าขนาดตลาดรวม (Total Addressable Market หรือ TAM) ของ Data Center AI Accelerator นี้น่าจะ “เติบโตขึ้นมากกว่า 70% ต่อปี” และภายในแค่ 4 ปีข้างนี้น่าจะ “มีมูลค่าสูงถึง 400,000 ล้านดอลลาร์สหรัฐ” เลยทีเดียว

จากกระแสโลกที่เห็นเด่นชัดว่า AI Workload และการประมวลผล Generative AI คือสิ่งที่ต้องการอย่างมหาศาลและไม่มีท่าทีจะลดลงแต่อย่างใด ภายในงาน AMD Advancing AI ทาง AMD จึงเปิดตัวผลิตภัณฑ์ที่ตอบรับความต้องการประมวลผล Generative AI ในทุกกลุ่มแบบ End-to-End Infrastructure ตั้งแต่ผลิตภัณฑ์ที่สนับสนุนภายใน Cloud, Data Center ไปจนถึงผลิตภัณฑ์สำหรับเครื่องคอมพิวเตอร์ส่วนบุคคลอย่าง AI PC เพื่อทำให้ประสบการณ์ประมวลผลใช้งาน Generative AI ได้ประสิทธิภาพสูงขึ้น

เปิดตัวกราฟิกการ์ด “AMD Instinct MI300 Series” สำหรับ Data Center

ผลิตภัณฑ์แรกที่ AMD เปิดตัวภายในงาน Advancing AI คือ “AMD Instinct MI300 Series” หน่วยประมวลผลสำหรับ Data Center ที่มีการใส่ GPU เข้าไปเพื่อสนับสนุน Workload ในระบบสมรรถนะสูง (HPC) และ AI ได้ดีขึ้นกว่าเดิม ด้วยสถาปัตยกรรม AMD CDNA 3 ที่ปรับให้เหมาะสมทั้งเรื่องประสิทธิภาพการประมวลผล AI และ HPC อย่างเช่นการสนับสนุนการคำนวณชนิดข้อมูลที่เป็น TF32 หรือ FP8 รวมทั้งเรื่องการใช้พลังงานได้อย่างคุ้มค่ามากขึ้น

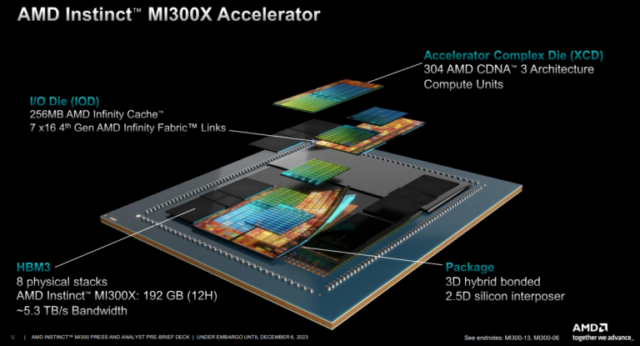

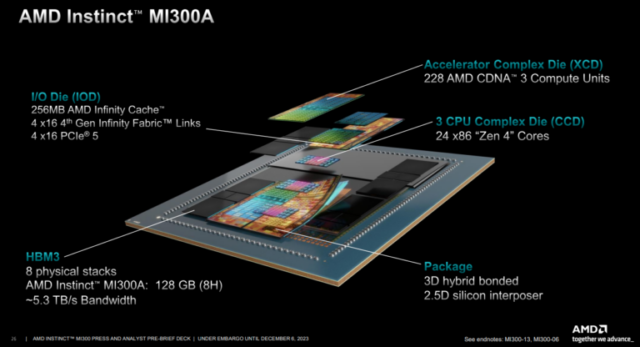

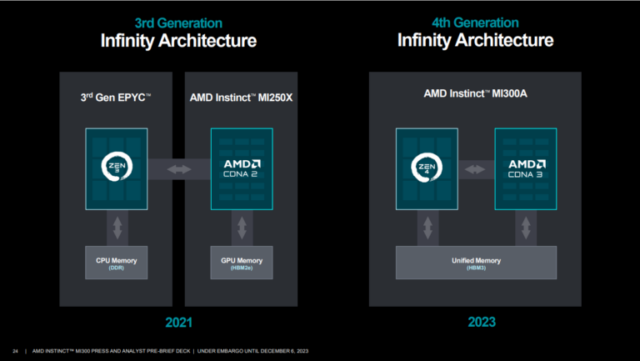

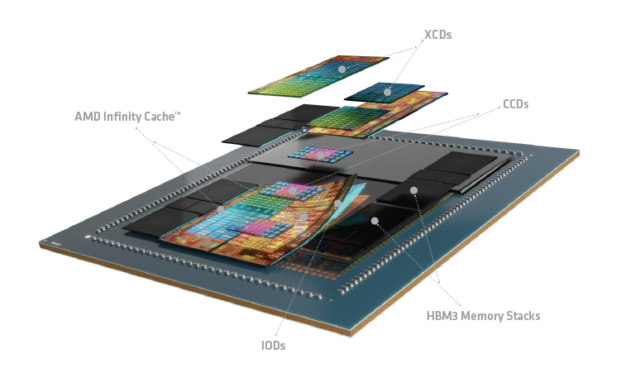

ด้วยสถาปัตยกรรม AMD CDNA 3 ที่ใช้เทคโนโลยีชิปเล็ต (Chiplet) และการบรรจุภัณฑ์ขั้นสูง (Advanced Packaging) แบบ 3D จึงทำให้สามารถวาง Accelerator Complex Dies (XCD) เรียงแนวตั้งได้ 8 ชิ้น พร้อมกับ I/O Die (IOD) อีก 4 ชิ้นไว้ด้วยกันผ่านเทคโนโลยี AMD Infinity Fabric ที่เชื่อมกับหน่วยความจำแบนด์วิดท์สูง (High-Bandwidth Memory หรือ HBM) อีก 8 Stack ทั้งหมดนี้ได้ทำให้เกิดผลิตภัณฑ์ต่าง ๆ ใน AMD Instinct MI300 Series ดังต่อไปนี้

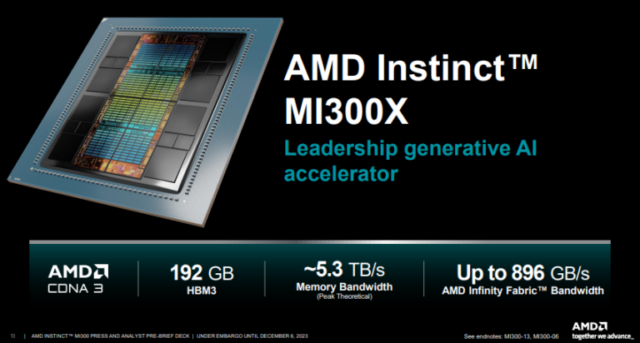

ชิป “AMD Instinct MI300X Accelerator” เน้นโหลด Generative AI

AMD Instinct MI300X Accelerator เป็นชิปประสิทธิภาพสูงสำหรับการประมวลผล Generative AI ล่าสุดจากทาง AMD ที่มีจำนวนทรานซิสเตอร์อยู่ภายในมากถึง “153 พันล้านชิ้น” ที่มี HBM3 สูงถึง 192 GB และมี Bandwidth สูงสุดราว ๆ 5.3 TB/s ซึ่งเหมาะกับการประมวลผลงาน Generative AI หรือ HPC ต่าง ๆ ไม่ว่าจะเป็นการ Training หรือ Inference ที่มีประสิทธิภาพสูงกว่ารุ่นก่อนหน้า AMD Instinct MI250X เกือบ 40% ในส่วนการประมวลผล และมีขนาด Memory มากกว่าเดิมถึง 1.5 เท่า

“AMD Instinct Platform” แพลตฟอร์มผสาน MI300X ไว้ 8 ตัว

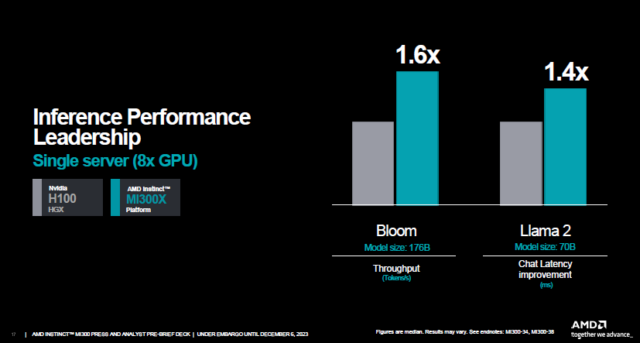

AMD Instinct Platform คือแพลตฟอร์มสำหรับการประมวลผล Generative AI ทรงประสิทธิภาพที่ AMD ผสมผสานหน่วยประมวลผล AMD Instinct MI300X ไว้ถึง 8 ตัวเข้าด้วยกันเพื่อทำให้มีความจุของหน่วยความจำ HBM3 สูงถึง 1.5 TB ซึ่งเมื่อเปรียบเทียบประสิทธิภาพกับ NVIDIA H100 HGX แล้ว แพลตฟอร์มนี้สามารถให้ Throughput (Token/s) ได้มากกว่าถึง 1.6 เท่าเมื่อทดสอบกับ BLOOM หรือสามารถเพิ่ม Chat Latency (ms) บน Llama 2 ได้มากกว่าถึง 1.4 เท่าเลยทีเดียว

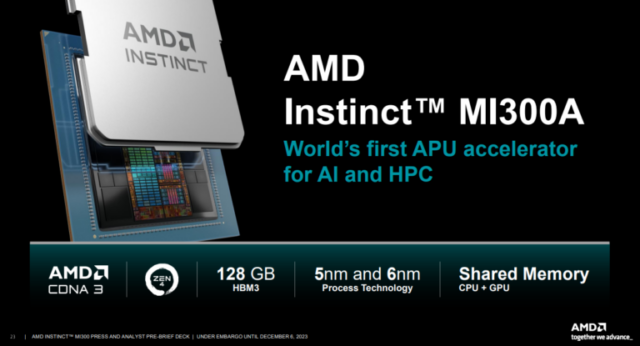

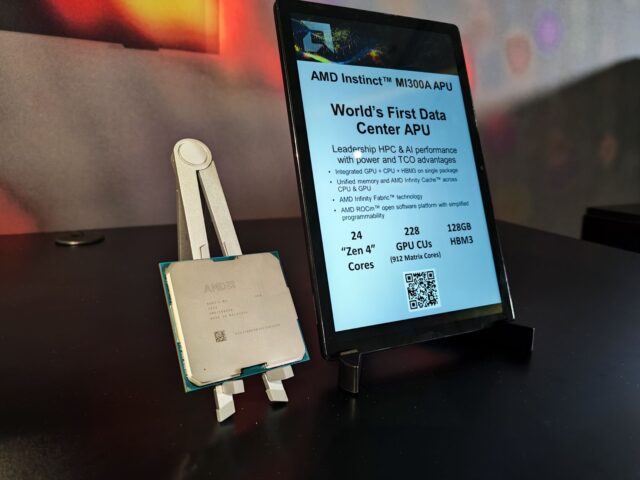

ชิป “AMD Instinct MI300A” เน้นกลุ่มงานประมวลผลสมรรถนะสูง HPC

AMD Instinct MI300A ชิปประสิทธิภาพสูงที่เน้นสำหรับงานที่ต้องการประมวลสมรรถนะสูง (High Performance Computing หรือ HPC) และ AI ซึ่งชิปนี้มีจุดเด่นคือเป็นชิป “Accelerated Processing Unit (APU)” ตัวแรกของโลก ที่มีการผสมผสาน GPU ที่เป็นสถาปัตยกรรม AMD CDNA 3 กับ CPU ที่เป็นสถาปัตยกรรม AMD Zen 4 ให้สามารถทำงานบน “หน่วยความจำร่วม (Shared Memory)” จึงทำให้ไม่จำเป็นต้องคัดลอก (Copy) ข้อมูลในการประมวลผลหรือว่าต้องรับส่งข้อมูลระหว่างกันอีกต่อไป พร้อมกับมี HBM3 สูงถึง 128 GB จึงทำให้สามารถส่งมอบประสิทธิภาพใน HPC หรือ AI Workload ที่เป็น FP32 ได้มากกว่ารุ่นก่อนหน้าหรือ AMD Instinct MI250X ถึง 1.9 เท่า

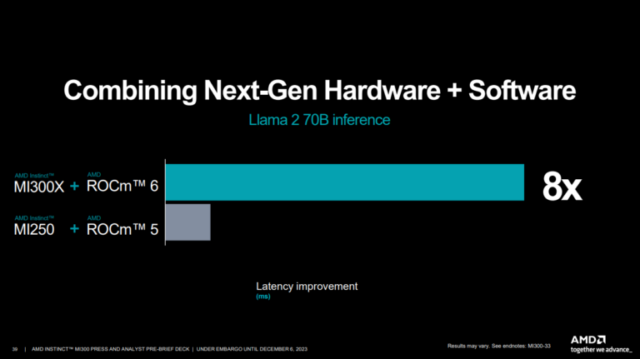

อัปเกรด “ROCm 6” ซอฟต์แวร์รีดประสิทธิภาพ LLMs บน Data Center

AMD ROCm 6 คือแพลตฟอร์มซอฟต์แวร์เปิด (Open Software Platform) ที่มีชุดเครื่องมือและ Library ที่เป็น State-of-the-art ต่าง ๆ เพื่อสนับสนุนให้นักพัฒนาระบบสามารถสร้างและใช้งานโมเดล AI โดยเฉพาะ Generative AI อย่าง LLMs ได้อย่างมีประสิทธิภาพสูงสุดบน GPU ของ AMD ซึ่งผลลัพธ์ตัวอย่างหนึ่งบน AMD Instinct MI300 Series ที่ AMD ยกมาคือสามารถเพิ่มประสิทธิภาพในการทำ Text Generation ด้วย Llama 2 ได้ประสิทธิภาพสูงขึ้นถึงราว 8 เท่า เมื่อเทียบกับรุ่นก่อนหน้า

นอกจากนี้ ROCm 6 ยังออกแบบมาเพื่อสนับสนุนนักพัฒนาระบบในการสร้างสรรค์ Generative AI โดยเฉพาะ LLM โดยภายในจะมีฟีเจอร์และชุด Library ใหม่ ๆ ให้เลือกใช้งานได้เลย เช่น FlashAttention, HIPGraph หรือ vLLM เป็นต้น รวมทั้งยังมีเฟรมเวิร์กหรือโมเดล AI ที่ Open Source จาก Hugging Face, PyTorch หรือ TensorFlow ให้สามารถเลือกหยิบใช้ได้ทันที

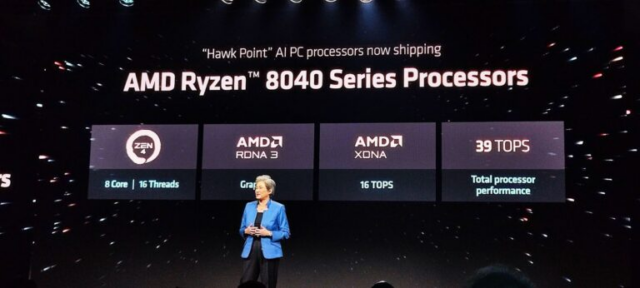

เตรียมพบกับ AMD Ryzen 8040 Series “Hawk Point” สำหรับ AI PC

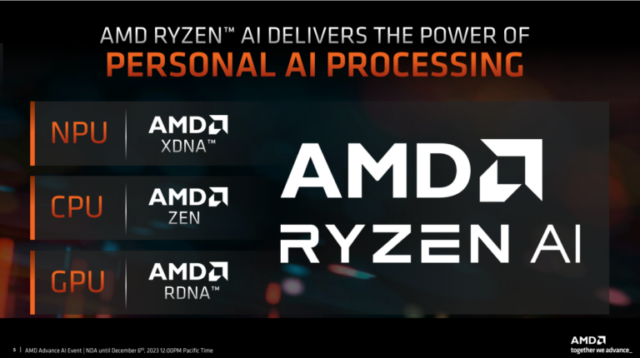

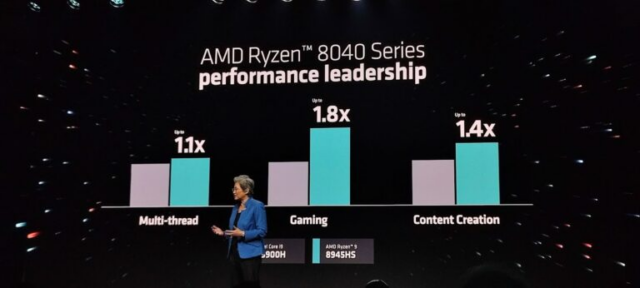

นอกจากชิประดับ Data Center แล้ว ในฝั่ง End Point อย่างเครื่องคอมพิวเตอร์ส่วนบุคคล AMD ยังได้เปิดตัวชิปซีรีส์ใหม่ “Hawk Point” หรือ “AMD Ryzen 8040 Series” ที่มาพร้อมกับ Ryzen AI ที่มีทั้ง CPU, GPU และ NPU อยู่บน Die เดียวกัน ซึ่งทำให้เครื่อง AI PC ที่ใช้ชิปรุ่นนี้จะมีประสิทธิภาพดีกว่ารุ่นก่อนหน้าถึงราว 1.6 เท่า รวมทั้งยังพร้อมสนับสนุนฟีเจอร์ AI ต่าง ๆ ที่อยู่ภายในเครื่องมือซอฟต์แวร์อย่างเช่น การตัดต่อวีดีโอ หรือเรนเดอร์ 3D ได้อย่างมีประสิทธิภาพมากยิ่งขึ้นกว่าเดิม โดย Hawk Point นี้คาดว่าน่าจะเริ่มเห็นบรรดาผู้ผลิตเริ่มปล่อยออกมาให้จับจองใช้งานกันได้ในช่วงไตรมาสแรกของปี 2024 นี้

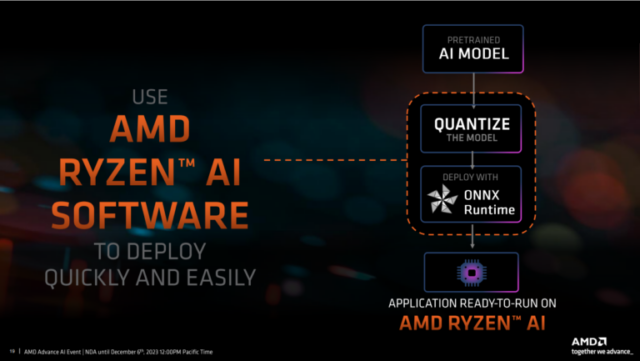

ปล่อย “AMD Ryzen AI 1.0 Software” หนุนนักพัฒนาระบบ

หลังจากที่ซอฟต์แวร์ Ryzen AI ได้ออกสู่ตลาด ก็ได้ทำให้นักพัฒนาระบบสามารถสร้างและ Deploy โมเดลที่พัฒนาจาก PyTorch หรือ TensorFlow ให้รับบนแล็ปท็อปที่มี Ryzen AI ได้ประสิทธิภาพสูงขึ้น ล่าสุด AMD จึงปล่อย “AMD Ryzen AI 1.0 Software” เพื่อสนับสนุนเหล่าบรรดานักพัฒนาระบบในการเพิ่มขีดความสามารถของ Generative AI ได้เร็วยิ่งขึ้น ด้วยการทำให้นักพัฒนาระบบสามารถเลือกโมเดล Pre-trained Model ที่ Open Source ไว้มาทำการ “Quantize” แล้วนำไป Deploy ผ่าน ONNX Runtime ที่สามารถรันบนเครื่องที่มี Ryzen AI บน Windows ได้ทันที (เวอร์ชันบน Linux ทาง AMD จะปล่อยออกมาในภายหลัง)

บทส่งท้าย

ทั้งหมดนี้คือสิ่งที่ทาง AMD ได้นำมาเปิดตัวในงาน AMD Advancing AI ในสัปดาห์ที่ผ่านมา ซึ่งเชื่อเหลือเกินว่าปีหน้านี้คงจะได้เห็นวิวัฒนาการของ Generative AI เร็วขึ้นอีกอย่างแน่นอน เพราะทั้งภายใน Data Center ที่จะสามารถรองรับ AI Workload อย่าง Generative AI ได้มากขึ้น รวมทั้ง AI PC ที่มีหน่วยประมวลผลที่ปรับให้เหมาะกับการรัน Generative AI ได้ดีขึ้นอีก

สิ่งเหล่านี้จะเป็นการส่งเสริมให้ทั้งพัฒนาการและการใช้งาน Generative AI แบบต่าง ๆ เป็นที่แพร่หลายในวงกว้างได้มากกว่าเดิม และสักวัน Generative AI ก็คงจะกลายเป็นสิ่งที่จะอยู่ทุกหนทุกแห่งบนโลกนี้ ซึ่งอาจเหมือนกับพลังงานไฟฟ้าดังที่ Andrew Ng ผู้คร่ำหวอดในวงการ AI เคยกล่าวไว้ว่า “AI is the new electricity” นั่นเอง

สำหรับงาน AMD Advancing AI สามารถรับชมย้อนหลังได้ผ่านลิงก์นี้ หรือ YouTube ด้านล่าง

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย