แม้ว่าหลายธุรกิจองค์กรจะเริ่มมีการพัฒนา AI และนำ AI มาใช้สร้างคุณค่าใหม่ๆ ให้กับธุรกิจแล้ว แต่ปัญหาหนึ่งที่หลายธุรกิจซึ่งต้องการใช้ AI ยังคงต้องเผชิญนั้น ก็คือการที่ระบบสำหรับการทำ AI Training และการทำ AI Inference นั้นยังไม่สามารถทำงานร่วมกันได้อย่างสมบูรณ์ ทำให้ท้ายที่สุดแล้วการทำงานจริงก็ขาดความคล่องตัวจากการที่ระบบ IT Infrastructure เหล่านี้ไม่สามารถเชื่อมต่อกันได้

NetApp ในฐานะของผู้นำด้านการบริหารจัดการข้อมูลสำหรับธุรกิจองค์กร จึงได้ร่วมมือกับ NVIDIA ผู้นำด้านเทคโนโลยีการประมวลผลสำหรับ AI พัฒนาโซลูชัน NetApp AI Pipeline Infrastructure ที่ไม่เพียงแต่นำ Hardware ที่ดีที่สุดในโลกของ Storage และ AI มาทำงานร่วมกันเท่านั้น แต่ยังนำ Software อย่าง Kubernetes มาใช้เพื่อรองรับ AI Workload ในการใช้งานรูปแบบที่แตกต่างกันไปอีกด้วย

ปัญหาใหญ่ของ AI Deep Learning Pipeline คือขาดความคล่องตัวในการทำงานจริง

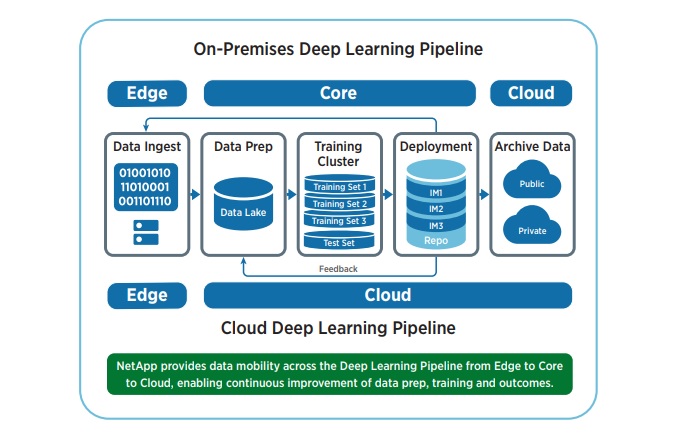

ที่ผ่านมานั้นธุรกิจองค์กรมักจะเริ่มต้นจากเพียงแค่การพัฒนา AI และนำ AI นั้นๆ มาใช้ให้เกิดผลลัพธ์ทางธุรกิจให้ได้ แต่ในระยะยาวนั้นหาก AI จะต้องถูกพัฒนามาขึ้นมาเพื่อรองรับงานที่หลากหลาย มีการปรับปรุงการทำงานของ AI อย่างต่อเนื่อง และถูกนำไปใช้ในระบบที่หลากหลายมากขึ้นและไม่จำกัดการใช้งานเพียงแค่ใน Data Center หรือ Cloud แต่ต้องถูกนำไปใช้ที่ Edge หรืออุปกรณ์ที่หลากหลายแล้ว สิ่งที่ธุรกิจองค์กรจะต้องการเพื่อตอบโจทย์เหล่านี้ก็คือการมี AI Deep Learning Pipeline

AI Deep Learning Pipeline ที่ดีนั้นควรจะต้องครอบคลุมทั้งการพัฒนา AI และการนำ AI ไปใช้งาน และจะต้องไม่จำกัด Environment ที่จะทำสิ่งต่างๆ เกี่ยวกับ AI โดยในแต่ละระบบนั้นก็อาจเลือกใช้ Hardware ที่แตกต่างกันเพื่อให้ตอบโจทย์การนำ AI ไปใช้งานในรูปแบบหรือสถานที่ที่แตกต่างกันได้ ในขณะที่ความง่ายในการดูแลรักษาหรือใช้งานระบบเหล่านี้ก็เป็นปัจจัยที่สำคัญ เพื่อให้ Data Scientist หรือนักวิทยาศาสตร์ข้อมูลนั้นสามารถทำงานได้อย่างคล่องตัวที่สุด

NetApp AI Pipeline Infrastructure: ย้ายข้อมูลได้อย่างอิสระจาก Edge สู่ Core และ Cloud พร้อมประมวลผลด้วย NVIDIA GPU ที่เหมาะสมกับงาน

เพื่อตอบโจทย์เหล่านี้ NetApp และ NVIDIA ในฐานะที่เป็นพันธมิตรกันมาอย่างยาวนานและเคยพัฒนาโซลูชันด้าน AI ร่วมกันมาอย่างต่อเนื่อง ก็ได้ทำการจับมือร่วมกันพัฒนาโซลูชัน NetApp AI Pipeline Infrastructure ที่ตอบโจทย์ด้านการพัฒนาและใช้งาน AI ครบทั้ง Pipeline ได้บนทั้ง Edge, Core และ Cloud

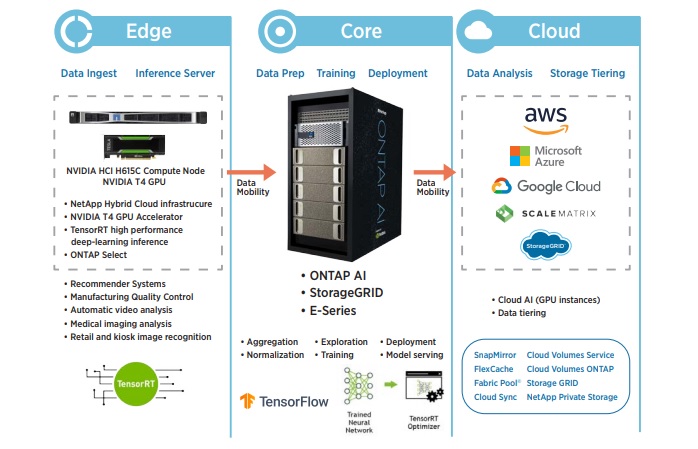

ในมุมของ NetApp นั้น Edge คือพื้นที่ที่ธุรกิจองค์กรจะได้รับข้อมูลใหม่ๆ จากผู้ใช้งาน, เครื่องจักร, อุปกรณ์ IoT และแหล่งข้อมูลอื่นๆ เพื่อนำข้อมูลเหล่านั้นส่งต่อไปยัง Core และทำการเรียนรู้เพื่อปรับปรุง AI ให้มีความแม่นยำมากยิ่งขึ้นหรือพัฒนา AI เพื่อตอบโจทย์ใหม่ๆ เพิ่มขึ้น จนเมื่อได้ Model ออกมาแล้วก็ทำการ Deploy กลับไปยัง Edge อีกที หรืออาจจะส่งข้อมูลต่อไปยัง Cloud เพื่อช่วยประมวลผล, นำไปใช้งานบนบริการ Cloud, ทำการวิเคราะห์ข้อมูลในภาพรวม หรือทำการเก็บรักษาข้อมูลระยะยาวในราคาที่คุ้มค่าก็ได้

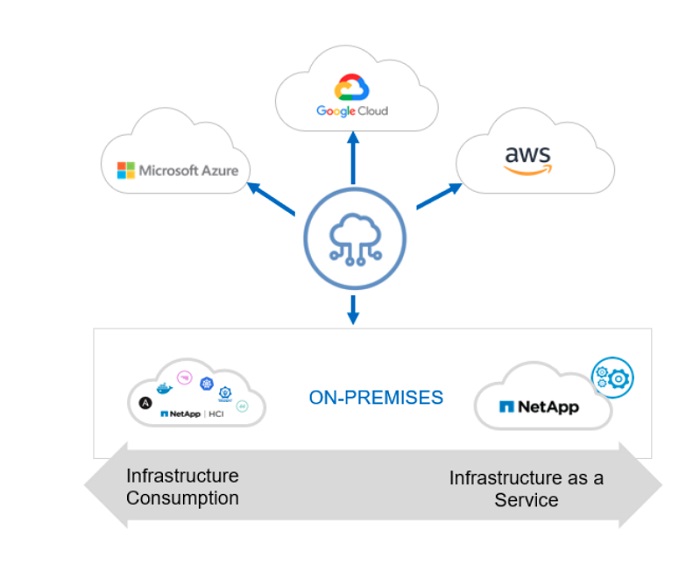

NetApp ได้ออกแบบให้มีการเลือกใช้ GPU ที่แตกต่างกันสำหรับ Edge, Core และ Cloud เพื่อให้เหมาะสมกับงานที่เกิดขึ้นในแต่ละส่วน และใช้สถาปัตยกรรม Data Fabric ในการเชื่อมผสานการรับส่งและบริหารจัดการข้อมูลบน Edge, Core และ Cloud เข้าด้วยกันเพื่อให้การรับส่งข้อมูลระหว่างระบบเกิดขึ้นได้อย่างมีประสิทธิภาพ, มั่นคงทนทาน และมั่นคงปลอดภัย โดยที่ในระบบเองก็มีการใช้ Kubernetes และ Kubeflow เพื่อให้สามารถย้ายระบบและการประมวลผลระหว่าง Edge, Core และ Cloud เกิดขึ้นได้อย่างอิสระและทำงานได้อย่างสมบูรณ์

ประมวลผลที่ Edge อย่างรวดเร็วและครบเครื่องด้วย NetApp HCI

สำหรับระบบที่ Edge ซึ่งต้องเน้นพลังประมวลผลในการทำ AI Inference, ความคล่องตัวในการเพิ่มขยาย และความง่ายดายในการบริหารจัดการนั้น NetApp ได้นำเสนอ NetApp HCI ที่ติดตั้ง NVIDIA GPU มาในตัว ทำให้สามารถตอบโจทย์ดังกล่าวได้อย่างครบถ้วน โดยการเลือกใช้ NVIDIA T4 GPU ก็ทำให้สามารถใช้ TensorRT Inference Server (TRIS) ได้ และทำให้การประมวลผล TensorFlow Model นั้นมีประสิทธิภาพสูงยิ่งขึ้น

ในแง่ของการจัดการกับข้อมูล NetApp HCI นี้สามารถทำงานร่วมกับโซลูชันอื่นๆ ของ NetApp บน Core และ Cloud ได้เป็นอย่างดี ทำให้สามารถทำการรับส่งข้อมูล, สำรองข้อมูล และบริหารจัดการข้อมูลจากศูนย์กลางได้ ง่ายต่อการนำข้อมูลที่ถูกสร้างขึ้นและบันทึกไว้ใน Edge ไปใช้งานต่อบนระบบอื่นๆ ในขั้นตอนของการทำ AI Deepl Learning Pipeline ได้

Train AI อย่างรวดเร็วด้วย NVIDIA DGX A100 ใน NetApp ONTAP AI

ในการทำ AI Training นั้น ทาง NetApp ได้เลือกนำ NVIDIA DGX A100 มาทำงานร่วมกับ NetApp AFF ภายใน NetApp ONTAP AI เพื่อให้การสร้าง AI Model จากข้อมูลปริมาณมหาศาลนั้นเกิดขึ้นได้อย่างมีประสิทธิภาพสูงสุด และสามารถทำการเพิ่มขยายพลังประมวลผลและพื้นที่จัดเก็บข้อมูลได้อย่างยืดหยุ่น

NetApp ONTAP AI นี้ยังได้ใช้จุดเด่นของ NVIDIA DGX A100 ที่สามารถแบ่ง Partition ได้มากถึง 56 Instance ต่อระบบ ทำให้สามารถแบ่งทรัพยากร GPU ที่ทรงพลังนี้ในการประมวลผลเพื่อสร้าง AI Model ใหม่ๆ สำหรับหลายโครงการได้พร้อมๆ กัน เพิ่มความคุ้มค่าในการใช้งานให้สูงขึ้น ในขณะที่ NetApp AFF เองก็รองรับการทำ QoS ทำให้มั่นใจได้ว่าทุกการประมวลผลนั้นจะสามารถเข้าถึงข้อมูลได้ด้วยความเร็วขั้นต่ำตามที่กำหนดอย่างแน่นอน

ภายในระบบยังมี NetApp AI Control Plane ที่ใช้ Kubernetes และ Kubeflow เพื่อทำการบริหารจัดการการ Deploy Container สำหรับส่วนต่างๆ ของงาน AI บนแต่ละระบบได้จากศูนย์กลาง ทำให้การเชื่อมต่อ Edge, Core และ Cloud เข้าด้วยกันนั้นกลายเป็นเรื่องที่ง่ายดาย

ส่งข้อมูลสู่ Cloud ได้อย่างอิสระและมั่นใจ ด้วย NetApp Data Fabric

สุดท้ายที่ส่วนของ Cloud ซึ่งมีความยืดหยุ่นสูงสุดและรองรับ Workload ได้หลากหลาย ทั้งการทำ AI Training, AI Inference ไปจนถึง Data Archiving นั้น NetApp ก็มีโซลูชัน NetApp StorageGRID ที่สามารถจัดเก็บข้อมูลบน Cloud และเชื่อมต่อกับ Edge และ Core ได้อย่างง่ายดาย ทำให้การย้ายข้อมูลที่จำเป็นต่องาน AI นั้นเกิดขึ้นได้บนบริการ Public Cloud ชั้นนำอย่างครบถ้วนทั้ง AWS, Microsoft Azure และ Google Cloud

สนใจติดต่อ Yip In Tsoi ได้ทันที

สอบถามรายละเอียดข้อมูลผลิตภัณฑ์เพิ่มเติมติดต่อ

เบอร์โทรศัพท์ 02 353 8600 ต่อ 3210

e-mail : yitmkt@yipintsoi.com

#NetApp

#YIPINTSOI

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย