Meta Platforms เปิดเผยว่า บริษัทได้ออกแบบชิปปรับแต่งพิเศษจำนวน 4 รุ่น เพื่อขับเคลื่อนเวิร์กโหลดปัญญาประดิษฐ์ภายในองค์กร

ก่อนหน้านี้บริษัทได้อัปเดตความคืบหน้าเกี่ยวกับการพัฒนาโปรเซสเซอร์ไปเมื่อปี 2024 โดยในเดือนเมษายนของปีนั้น Meta ได้เปิดตัวตัวเร่งความเร็ว AI ที่ใช้พลังงาน 90 วัตต์ อย่างไรก็ตาม ตัวเร่งความเร็วที่ล้ำสมัยที่สุดในบรรดา 4 รุ่นที่เปิดตัวในวันนี้มีค่าการออกแบบการใช้พลังงานความร้อนสูงถึง 1,700 วัตต์

ชิปปรับแต่งพิเศษที่บริษัทเปิดตัวเมื่อเดือนเมษายน 2024 อย่าง MTIA 200 นั้น ถูกออกแบบมาเพื่อรันโมเดลการจัดอันดับและการแนะนำโดยเฉพาะ ซึ่งเป็นโครงข่ายประสาทเทียมที่ Meta ใช้เพื่อตัดสินใจว่าควรแสดงโพสต์และโฆษณาใดในฟีดของผู้ใช้

ชิปรุ่นแรกที่เปิดตัวในวันนี้คือ MTIA 300 มุ่งเน้นไปที่รูปแบบการใช้งานแบบเดียวกัน โดยสามารถให้ประสิทธิภาพการประมวลผลได้ที่ 1.2 เพตะฟลอปส์ เมื่อประมวลผลข้อมูลในรูปแบบ MX8 และมาพร้อมกับหน่วยความจำ HBM ขนาด 216 กิกะไบต์

“MTIA 300 ประกอบด้วยชิปเลตประมวลผล 1 ตัว, ชิปเลตเครือข่าย 2 ตัว และสแตก HBM อีกหลายตัว” กลุ่มวิศวกรของ Meta เขียนในบล็อกโพสต์ “ชิปเลตประมวลผลแต่ละตัวประกอบด้วยตารางขององค์ประกอบการประมวลผล (PE) พร้อมด้วย PE สำรองบางส่วนเพื่อเพิ่มผลผลิต”

MTIA 300 เป็นเพียงรุ่นเดียวในบรรดาชิป 4 รุ่นที่เปิดตัวใหม่ซึ่ง Meta ได้เริ่มนำไปใช้งานจริงในขั้นตอนการผลิตแล้ว ส่วนโปรเซสเซอร์อีก 3 รุ่นที่เหลือนั้นรองรับการใช้งานที่กว้างขวางกว่า นอกเหนือจากเวิร์กโหลดการจัดอันดับและการแนะนำแล้ว พวกมันยังสามารถรันซอฟต์แวร์ AI แบบรู้สร้าง เช่น โมเดลภาษาขนาดใหญ่ ได้อีกด้วย

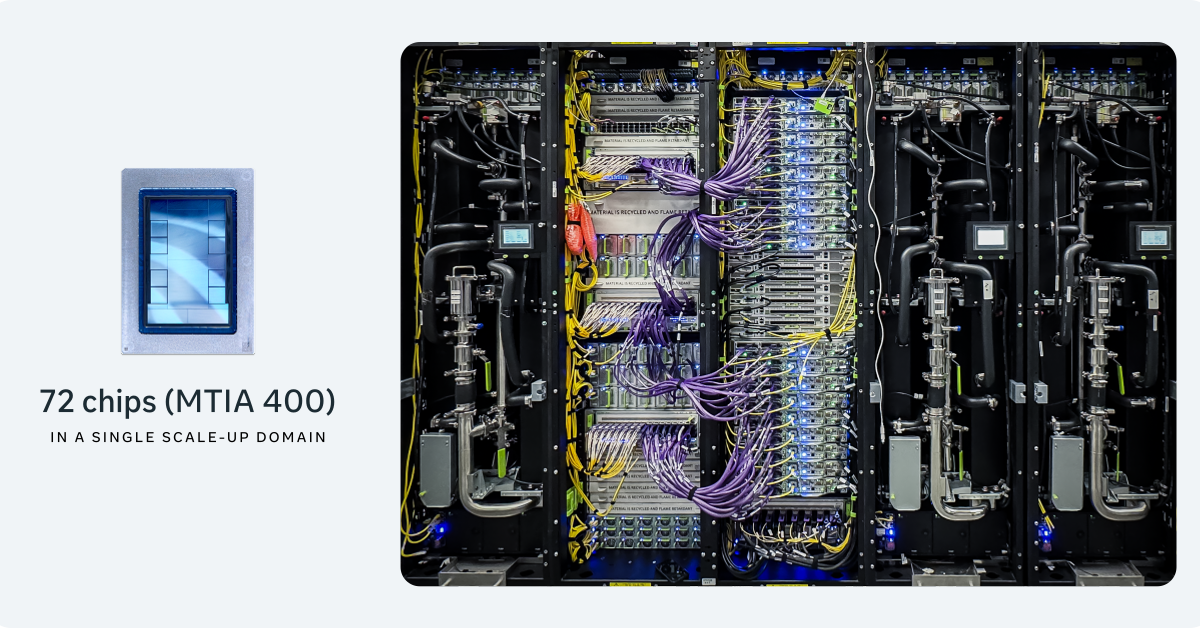

ชิปที่ล้ำหน้าที่สุดในไลน์อัปนี้คือ MTIA 500 ซึ่งให้ประสิทธิภาพสูงถึง 10 เพตะฟลอปส์ เมื่อประมวลผลข้อมูล MX8 นอกจากนี้ยังรองรับรูปแบบข้อมูลที่มีประสิทธิภาพมากขึ้นที่เรียกว่า MX4 ซึ่งเทคโนโลยีหลังนี้จะช่วยลดจำนวนไบต์ที่โมเดล AI ต้องวิเคราะห์เพื่อตอบคำถาม ส่งผลให้การประมวลผลรวดเร็วขึ้น

MTIA 500 ดำเนินการคำนวณโดยใช้ชิปเลตตรรกะจำนวน 4 ตัว โมดูลเหล่านี้ถูกล้อมรอบด้วยสแตกหน่วยความจำ HBM หลายตัวที่สามารถจัดเก็บข้อมูลรวมกันได้สูงสุดถึง 516 กิกะไบต์ หรือเป็นสองเท่าของ MTIA 300 นอกจากนี้ยังมีส่วนประกอบที่เรียกว่าชิปเลต SoC ซึ่งทำหน้าที่รับส่งข้อมูลไปยังเซิร์ฟเวอร์โฮสต์

คาดว่า MTIA 500 จะเข้าสู่กระบวนการผลิตในปี 2027 พร้อมกับชิปที่มีความสามารถใกล้เคียงกันแต่ซับซ้อนน้อยกว่าอย่าง MTIA 450 โดยโปรเซสเซอร์ทั้งสองรุ่นถูกปรับแต่งมาเพื่อเวิร์กโหลดอินเฟอเรนซ์ของ AI แบบรู้สร้างโดยเฉพาะ พวกมันมีวงจรที่ออกแบบมาเพื่อเร่งองค์ประกอบเฉพาะที่ใช้ทรัพยากรฮาร์ดแวร์สูงในกระบวนการอินเฟอเรนซ์ เช่น FlashAttention ซึ่งเป็นวิธีการติดตั้งกลไกความใส่ใจยอดนิยมที่ LLM ใช้ในการวิเคราะห์ข้อมูลขาเข้า

“ในระดับระบบ MTIA 400, 450 และ 500 ล้วนใช้โครงสร้างตัวเครื่อง แร็ก และโครงสร้างพื้นฐานเครือข่ายเดียวกัน” วิศวกรของ Meta ระบุ “ดังนั้น ชิปแต่ละรุ่นใหม่จึงสามารถนำไปวางในพื้นที่ทางกายภาพเดิมได้ทันที ช่วยเร่งการเปลี่ยนผ่านจากซิลิกอนไปสู่การใช้งานจริงในการผลิต นอกจากนี้ การออกแบบที่ถอดประกอบและนำกลับมาใช้ใหม่ได้ของเรา ยังช่วยลดทรัพยากรที่จำเป็นในการพัฒนาและติดตั้งชิปในหลาย ๆ รุ่นอีกด้วย”

Meta ใช้คอมไพเลอร์ที่ปรับแต่งเองเพื่อเพิ่มประสิทธิภาพโมเดล AI สำหรับชิป MTIA นอกจากนี้ยังมีโมดูลซอฟต์แวร์ปรับแต่งพิเศษอีกตัวคือ Hoot Collective Communications Library ที่ทำหน้าที่จัดการการไหลของข้อมูลระหว่างโปรเซสเซอร์ โดยจะดำเนินการคำนวณบางอย่างโดยใช้ทรานซิสเตอร์ที่อยู่ใกล้กับเซลล์หน่วยความจำ ซึ่งช่วยลดเวลาการเดินทางของข้อมูลและเพิ่มประสิทธิภาพการทำงาน

การเปิดตัวชิปเหล่านี้เกิดขึ้นไม่ถึงหนึ่งเดือนหลังจากที่ Meta ตกลงซื้อโปรเซสเซอร์มูลค่าหลายพันล้านดอลลาร์จาก Nvidia และ Advanced Micro Devices ในช่วงเวลาใกล้เคียงกัน แหล่งข่าวบอกกับ The Information ว่าบริษัทแม่ของ Facebook ยังมีแผนที่จะนำตัวเร่งความเร็ว TPU ของ Google มาใช้ด้วย โดยมีรายงานว่าจะใช้ชิปดังกล่าวเพื่อรันโมเดลภาษาขนาดใหญ่

ที่มา: https://siliconangle.com/2026/03/11/meta-debuts-internally-developed-ai-chips-inference-workloads/

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย