Generative AI ที่เกิดขึ้นมาก่อนหน้านี้และที่กำลังใช้งานกันอยู่ในปัจจุบัน ส่วนใหญ่นั้นจะเป็นการอิงโครงสร้างสถาปัตยกรรม Transformer ซึ่งอ้างอิงมาจากงานตีพิมพ์ Attention Is All You Need อันโด่งดัง หากแต่ล่าสุด Liquid AI ได้ออกมาเปิดตัวโมเดลใหม่ที่ไม่ได้อิง Transformer และอาจเป็นโมเดล Generative AI แห่งอนาคต

Liquid AI คือสตาร์ตอัปที่ก่อตั้งโดยอดีตนักวิจัยจากห้องปฏิบัติการ CSAIL แห่ง MIT ซึ่งล่าสุดได้ประกาศเปิดตัวโมเดล Multimodal ภายใต้ชื่อ “Liquid Foundation Models (LFMs)” โดยสิ่งที่น่าสนใจและควรจับตาอย่างยิ่งคือ โมเดล Generative AI นี้ ไม่ได้อิงจากสถาปัตยกรรม Transformer แต่อย่างใดแล้ว

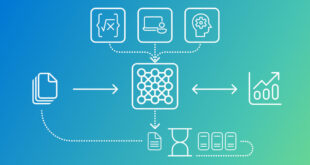

โดย Liquid AI ได้กล่าวว่าเป้าหมายของการสร้างสิ่งนี้ “คือการค้นหาแนวทางใหม่ในการสร้าง Foundation Model ที่เหนือกว่าโมเดลที่เป็น Generative Pre-trained Transformers (GPTs)” ซึ่ง LFM นี้เป็นเหมือนรากฐานสำหรับการสร้างสิ่งต่าง ๆ ที่ต่อยอดขึ้นไป เหมือนเครื่องยนต์แล้วต่อด้วยรถยนต์ แล้วก็เครื่องบิน เป็นต้น

ปัจ จุบัน Liquid AI ได้เปิดตัว LFMs ออกมาใน 3 ขนาด ได้แก่ LFM 1.3B (เล็กที่สุด), LFM 3B และ LFM 40B MoE (Mixture-of-Experts ที่เหมือนกับ Mixtral ของ Mistral) ซึ่ง Liquid AI เคลมว่า LFM 1.3B ที่เล็กที่สุดนั้นมีความสามารถที่เหนือกว่า Llama 3.2 1.2B ของ Meta และ Phi-1.5 ของ Microsoft แล้วในหลาย ๆ การทดสอบ

ดูเหมือนว่าสิ่งที่ Yan LeCunn หนึ่งในผู้เชี่ยวชาญด้าน AI ชั้นนำของโลกได้ออกมากล่าวว่า “ถ้าหากจะสร้าง AI สำหรับยุคถัดไป อย่าโฟกัสที่ LLM” อาจจะกำลังเกิดขึ้น จึงควรจับตาวิวัฒนาการของ Liquid AI ที่ Spin Off มาจาก CSAIL แห่ง MIT อย่างยิ่ง ว่าจะสามารถต่อยอดโมเดล LFMs ให้พัฒนาเหนือกว่า LLMs ที่ใช้ Transformer เป็นฐานได้ขนาดไหนต่อไป

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย