Google ได้เปิดให้บริการเบต้าเวอร์ชันของ TPU Pods v2 และ v3 ซึ่งเกิดจากการรวมกลุ่มของ Tensor Processing Units (TPU) ในหลายๆ Rack เชื่อมเข้าด้วยกันให้สามารถทำงานได้ซึ่งเทียบเท่าได้กับการมี Supercomputing เลยทีเดียว

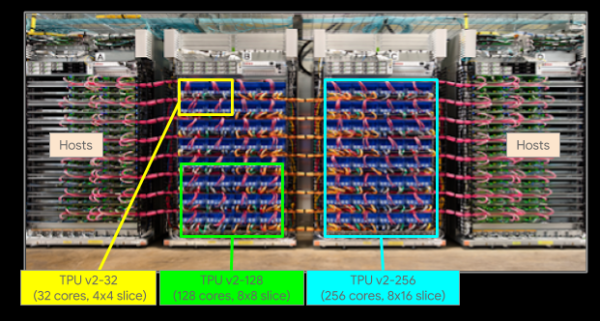

TPU Pod อธิบายง่ายๆ คือการนำหลายอุปกรณ์มาเชื่อมต่อกันให้ทำงานร่วมกันได้โดยในกรณีของ Google TPU Pods ได้ใช้ Two-dimesional mesh network (ดูรูปประกอบได้ตามด้านบน) และใช้ Software Stack ทำให้สามารถโปรแกรมหลายเครื่องให้เหมือนเป็นเครื่องเดียวผ่านทาง APIs

*อธิบายเพิ่มเติมจากข้อมูลของ Google ว่า TPU v2-8 ปกติหมายถึง 1 TPU Deviceที่จะมีชิป 4 ตัวแต่ละชิปมี 2 คอร์ทำให้มีสูงสุดได้ 8 คอร์ แต่หากเป็น TPU v2 Pod จะเกิดจาก 64 TPU Devices ซึ่งมีชิปถึง 256 ตัว (มีคอร์สูงสุดถึง 512) ที่เชื่อมต่อกันด้วยอินเทอร์เฟสความเร็วสูง

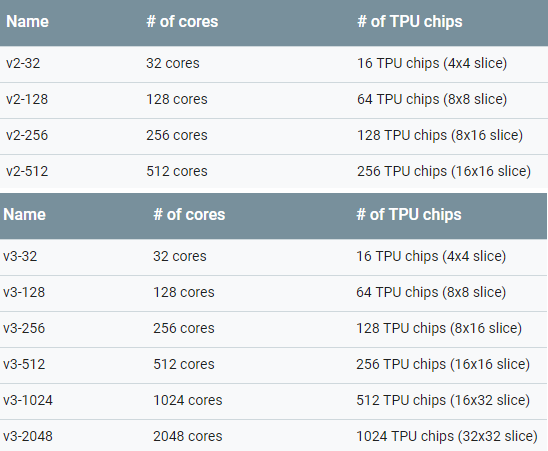

อย่างไรก็ตาม Google เล็งเห็นในระดับการใช้งานจริงว่าอาจจะไม่ต้องใช้งานถึง 1 Pods จึงแบ่งหน่วยย่อยลงให้ผู้สนใจเริ่มต้นที่ชื่อว่า ‘Slices’ ซึ่งมีหลายขนาดใน TPU Pod v2 และ v3สามารถชมได้ตามตารางด้านล่าง

โดยในครั้งนี้ Google หวังว่า TPU Pod จะช่วยสนับสนุนนักวิจัยด้าน Machine Learning ในการเทรนและสร้างโมเดลกับข้อมูลจำนวนมากอย่างมีนัยสำคัญซึ่งหากพิจารณา TPU v3 Pods ขนาดสูงสูงจะมีชิป TPU มากกว่า 1,000 ตัวที่ให้พลังประมวลผลถึง 100 petaFLOPs หรือเทียบเท่าได้กับการมี Supercomputer มาใช้งานเองเลยทีเดียว

ที่มา : https://www.zdnet.com/article/google-makes-cloud-tpu-pods-publicly-available-in-beta/

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย