Cohere สตาร์ตอัป AI ที่ก่อตั้งโดยอดีตนักวิจัยแห่ง Google Brain ผู้สร้างสถาปัตยกรรม Transformer ล่าสุดได้เปิดตัว 2 โมเดล Open Weight ใหม่ภายในโครงการ Aya ที่จะปิดช่องว่างทางภาษาภายใน Foundation Model ได้มากขึ้น

Cohere บริษัทที่ก่อตั้งโดยนักวิจัยผู้ที่อยู่เบื้องหลังงานวิจัย Attention Is All You Need ล่าสุดได้เปิดตัว Aya Expanse 8B และ 35B บน Hugging Face ที่ขยายขีดความสามารถก้าวหน้าขึ้นในอีก 23 ภาษา

โดย Aya เป็นโครงการที่จะพยายามทำให้การเข้าถึง Foundation Model ทั่วโลกเป็นได้มากกว่าแค่ภาษาอังกฤษ ซึ่ง Cohere for AI แผนกวิจัยของบริษัทนั้นได้เปิดตัวโครงการ Aya มาตั้งแต่ช่วงปีที่แล้ว และเมื่อกุมภาพันธ์ที่ผ่านมาก็ได้ปล่อยโมเดล Aya 101 LLM ขนาด 13B ที่ครอบคลุมได้ถึง 101 ภาษา พร้อมกับข้อมูล Data Set ที่จะช่วยให้เข้าถึงภาษาอื่น ๆ ได้มากขึ้นด้วย

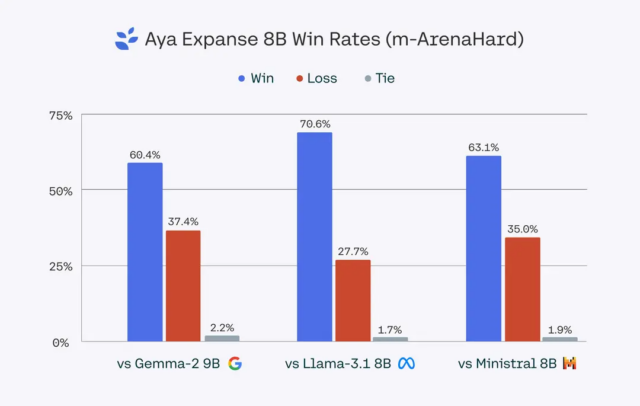

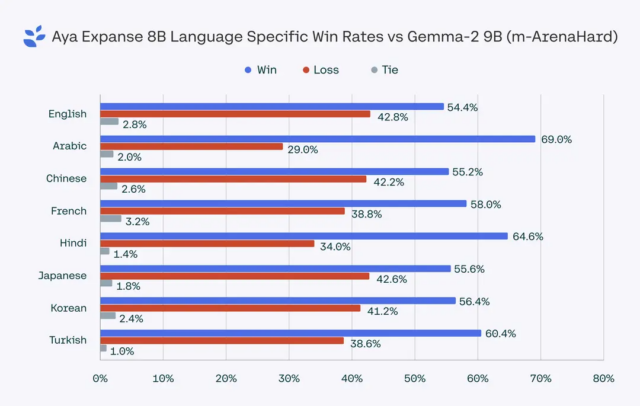

และล่าสุด Cohere ได้ปล่อยอีก 2 โมเดลออกมา ซึ่งตามที่กล่าวในบล็อกโพสเผยว่าโมเดลขนาด 8B พารามิเตอร์เรียกว่าเป็น Breakthrough ที่ทำให้นักวิจัยสามารถเข้าถึงได้มากขึ้นทั่วโลก ในขณะที่โมเดลขนาด 32B พารามิเตอร์นั้นเรียกว่าเป็น State-of-the-art ในหลายภาษา (Multilingual) ได้เลย ไม่ว่าจะเป็นภาษาอารบิก จีน ฝรั่งเศา ญี่ปุ่น เกาหลี ตุรกี ฮินดี

รายละเอียดเพิ่มเติมเกี่ยวกับโมเดลใหม่ภายใต้โครงการ Aya สามารถอ่านเพิ่มเติมได้ที่นี่

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย