ในยุคที่เทคโนโลยีปัญญาประดิษฐ์ (AI) ทวีความสำคัญและขับเคลื่อนการเปลี่ยนแปลงในทุกอุตสาหกรรม สิ่งที่เป็น “หัวใจ” และ “รากฐาน” สำคัญที่สุดคือ Data Center ที่ต้องรับมือกับความต้องการพลังงานและการประมวลผลอันมหาศาล

เมื่อวันที่ 9 ตุลาคม 2025 ในงาน Tech Forum Bangkok 2025 ณ ไบเทค บางนา คุณศรัณยู ดาวนันท์ Pre-Sales Consultant จาก Schneider Electric ได้มาเปิดเผยถึงบทบาทวิกฤตของ Data Center ในฐานะเสาหลักของ AI พร้อมทั้งฉายภาพแนวโน้มสำคัญที่ผู้ประกอบการและนักพัฒนาไม่ควรมองข้าม นั่นคือการยกระดับ Data Center ให้มีความยืดหยุ่น (Resilience) และความยั่งยืน (Sustainability) เพื่อให้พร้อมรองรับการเติบโตอย่างก้าวกระโดดของ AI ที่มาพร้อมกับความท้าทายด้านการใช้พลังงาน

บทสรุปนี้ TechTalkThai จะพาไปเจาะลึกวิสัยทัศน์และแนวทางปฏิบัติที่เน้นการสร้างสรรค์ Data Center แห่งอนาคต ที่ไม่ได้เป็นเพียงแค่ศูนย์รวมข้อมูล แต่เป็นขุมพลังอัจฉริยะ ที่ขับเคลื่อนนวัตกรรม AI ได้อย่างต่อเนื่องและเป็นมิตรต่อสิ่งแวดล้อม

Data Center หัวใจสำคัญของยุค AI

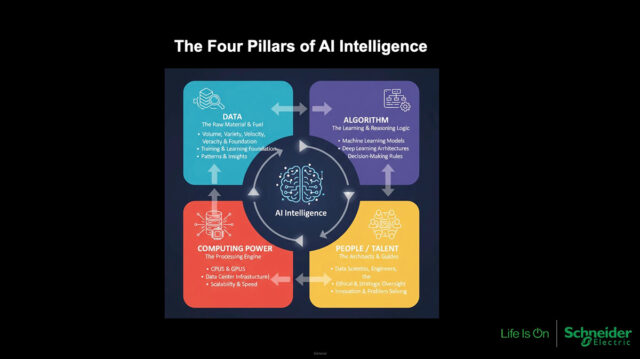

เทคโนโลยี AI ประกอบด้วยองค์ประกอบหลัก 4 ส่วน คือ Algorithm, Data, Computing Power, และ People โดย Computing Power หรือพลังการประมวลผล ซึ่งมี Data Center เป็นพื้นฐาน ถือเป็นจิ๊กซอว์ที่สำคัญอย่างยิ่ง เพราะแม้ AI จะฉลาดเท่ากัน แต่หาก Data Center ใช้พลังงานมากกว่า ก็จะขาดความสามารถในการแข่งขัน (Competitiveness) อยู่ดี

การลงทุนในระบบประมวลผลคอมพิวเตอร์ ไม่ว่าจะสร้างเองหรือใช้บริการคลาวด์ ต้องพิจารณาประเด็นสำคัญ 2 ข้อหลัก คือ

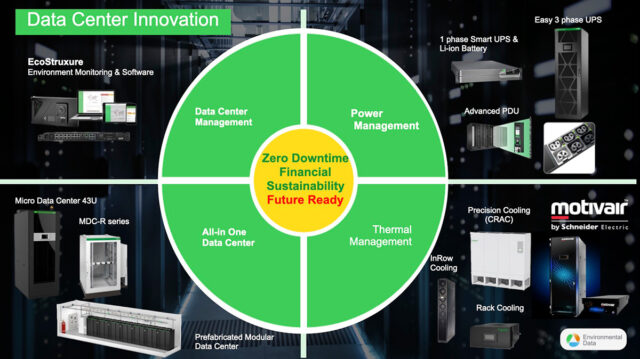

- Zero Downtime: ความเสี่ยงในการหยุดทำงานต้องต่ำที่สุด เพราะการล่มของดาต้าเซ็นเตอร์หมายถึงความล้มเหลวทางธุรกิจ

- Financial Performance: ผลตอบแทนทางการเงินในระยะยาว (Long-Term Investment/Opex)

Schneider Electric มุ่งเน้นการออกแบบและนำเสนอเทคโนโลยีที่ช่วยลดการ Trade-Off ระหว่าง 2 ปัจจัยนี้ เพื่อให้ได้ทั้งความยืดหยุ่นและความยั่งยืน ซึ่งเป็นความหมายของ Sustainable Data Center

องค์ประกอบหลักของศูนย์ข้อมูลยั่งยืน (Sustainable Data Center)

ศูนย์ข้อมูล (Data Center) เป็นโครงสร้างพื้นฐานสำคัญของโลกดิจิทัลในปัจจุบัน แต่ก็เป็นผู้ใช้พลังงานรายใหญ่ที่ส่งผลกระทบต่อสิ่งแวดล้อม การเปลี่ยนผ่านสู่ศูนย์ข้อมูลยั่งยืน (Sustainable Data Center) จึงเป็นสิ่งจำเป็นเพื่อลดการใช้พลังงาน ลดต้นทุน และลดผลกระทบทางสิ่งแวดล้อม การบรรลุเป้าหมายดังกล่าวต้องอาศัยการปรับปรุงองค์ประกอบหลักดังต่อไปนี้

1. Power Management การจัดการระบบไฟฟ้าการลดการสูญเสียพลังงานสูงสุด

ระบบไฟฟ้า เป็นหัวใจสำคัญของศูนย์ข้อมูลที่ต้องมีความน่าเชื่อถือสูง แต่ก็เป็นแหล่งของการสูญเสียพลังงานที่สำคัญ

ด้านความท้าทายของการสูญเสียพลังงาน: โดยทั่วไป การสูญเสียพลังงาน (Power Loss) ในระบบทางผ่านไฟฟ้า (Power Path) เช่น ในเครื่องสำรองไฟ (Uninterruptible Power Supply: UPS) หรืออุปกรณ์แปลงไฟต่างๆ มักอยู่ที่ประมาณ 6-7% ของพลังงานทั้งหมด ซึ่งถือเป็นค่าใช้จ่ายที่สูงมากในระยะยาวสำหรับศูนย์ข้อมูลขนาดใหญ่

ด้านนวัตกรรมเพื่อการประหยัดพลังงาน: Schneider Electric ได้พัฒนานวัตกรรมที่มุ่งเน้นการเพิ่มประสิทธิภาพของระบบไฟฟ้า โดยเฉพาะอย่างยิ่งในส่วนของ UPS และระบบจ่ายไฟ เพื่อลดการสูญเสียพลังงานให้เหลือเพียงประมาณ 1% โดยยังคงรักษา ความน่าเชื่อถือ (Reliability) ของระบบไว้ได้เต็มที่ ซึ่งการลดการสูญเสียในส่วนนี้หมายถึงการประหยัดพลังงานโดยรวมของศูนย์ข้อมูลได้อย่างน้อย 5% ทำให้เกิดผลตอบแทนทางการลงทุน (ROI) ที่คุ้มค่าและลดการปล่อยก๊าซเรือนกระจกได้อย่างมาก

2. ระบบปรับอากาศ (Cooling System) – หัวใจของการใช้พลังงาน

ระบบปรับอากาศ เป็นองค์ประกอบที่ใช้พลังงานมากที่สุดในศูนย์ข้อมูล เนื่องจากความร้อนที่เกิดขึ้นจากการประมวลผลของเซิร์ฟเวอร์

หากการใช้พลังงานที่สูงและเกณฑ์ประสิทธิภาพ: ในศูนย์ข้อมูลทั่วไป ระบบปรับอากาศอาจใช้พลังงานเพิ่มเติมสูงถึง 50-60% ของพลังงานที่ใช้ในการประมวลผล (Compute Power) ซึ่งเป็นสัดส่วนที่สูงมากแม้แต่ศูนย์ข้อมูลที่ออกแบบมาดีที่สุดในประเทศไทย ก็ยังคงมีสัดส่วนการใช้พลังงานของระบบปรับอากาศอยู่ที่ประมาณ 30% ของพลังงานประมวลผล

การออกแบบเพื่อประสิทธิภาพสูงสุด

การออกแบบระบบปรับอากาศของศูนย์ข้อมูลยั่งยืนจึงต้องเน้นที่ประสิทธิภาพพลังงาน (Energy Efficiency) เป็นอันดับแรก ซึ่งรวมถึง:

- การนำเทคนิคอย่าง Containment (การแยกอากาศร้อนและเย็น) มาใช้

- การใช้เทคโนโลยี Free Cooling (การนำอากาศภายนอกหรือน้ำมาช่วยทำความเย็นเมื่อสภาพอากาศเอื้ออำนวย)

- การนำ Liquid Cooling (การทำความเย็นด้วยของเหลว) เข้ามาใช้ Liquid Cooling เป็นเทคโนโลยีที่กำลังเป็นที่นิยมมากขึ้นเรื่อยๆ เนื่องจากสามารถระบายความร้อนได้อย่างมีประสิทธิภาพสูง โดยเฉพาะสำหรับเซิร์ฟเวอร์ที่มีความหนาแน่นพลังงานสูง (High-Density Racks) ซึ่งช่วยลดภาระการทำงานของระบบปรับอากาศแบบเดิมได้อย่างมหาศาล

3. การมอนิเตอร์และบริหารจัดการ (Monitoring & Management) การเฝ้าระวังเชิงรุก

การมีฮาร์ดแวร์ที่มีประสิทธิภาพสูงเพียงอย่างเดียวไม่เพียงพอ การมอนิเตอร์และบริหารจัดการ ถือเป็นสิ่งสำคัญในการรักษาประสิทธิภาพและความยั่งยืนในระยะยาว

การเฝ้าระวังเชิงรุก (Proactive Monitoring) ด้วยระบบ Monitoring หรือ ซอฟต์แวร์บริหารจัดการโครงสร้างพื้นฐานของศูนย์ข้อมูล (DCIM: Data Center Infrastructure Management) เข้ามามีบทบาทสำคัญในการรวบรวมข้อมูลสถานะการทำงานของอุปกรณ์ทั้งหมด เช่น อุณหภูมิ ความชื้น กระแสไฟฟ้า และประสิทธิภาพการใช้พลังงาน

ระบบเหล่านี้จะสามารถแจ้งเตือนความเสี่ยง (Risk Alert) ได้อย่างรวดเร็วและเชิงรุก ก่อนที่อุณหภูมิจะสูงเกินไป ระบบไฟฟ้าจะขัดข้อง หรือประสิทธิภาพจะลดลง ทำให้ผู้ดูแลสามารถแก้ไขปัญหาได้ ทันท่วงที ลดโอกาสที่ระบบจะล่ม (Downtime) และรักษาประสิทธิภาพการใช้พลังงานให้อยู่ในระดับที่เหมาะสมอย่างต่อเนื่อง

4. All-in One Data Center การติดตั้งที่รวดเร็ว (Fast Deployment)

ความต้องการในการติดตั้งศูนย์ข้อมูลที่รวดเร็วและมีความยืดหยุ่นสูง เพื่อตอบสนองต่อการขยายตัวของเทคโนโลยี Edge Computing และเพื่อแก้ไขข้อจำกัดของอาคารเดิม นำไปสู่ความนิยมของโซลูชันแบบ All-in-One เพื่อ

- เพื่อแก้ไขข้อจำกัดของพื้นที่และพลังงานในอาคารสำนักงานเดิม เช่น ปัญหาไฟไม่พอ หรือ แอร์ไม่พอในการรองรับเซิร์ฟเวอร์ที่เพิ่มขึ้น Micro Data Center หรือ ตู้ All-in-One (Enclosed Rack System) จึงกลายเป็นทางเลือกที่น่าสนใจ

- ตู้เหล่านี้ออกแบบมาให้ติดตั้งระบบแอร์และระบบไฟฟ้าสำรองทั้งหมดไว้ในตู้เดียว ทำให้ ติดตั้งง่าย ย้ายได้ และมีความยืดหยุ่นสูง

- ข้อดีด้านความยั่งยืนที่สำคัญคือ ตู้เหล่านี้สามารถควบคุมอุณหภูมิเฉพาะจุดได้อย่างแม่นยำและมีประสิทธิภาพสูง คล้ายกับการทำความเย็นให้กับ “ตู้เย็น” เพียงใบเดียว แทนที่จะต้องใช้พลังงานมหาศาลเพื่อทำความเย็นทั้งห้อง ทำให้ประหยัดค่าใช้จ่ายด้านพลังงาน ได้มากเมื่อเทียบกับการปรับปรุงห้องเซิร์ฟเวอร์แบบดั้งเดิม

PUE (Power Usage Effectiveness) ดัชนีชี้วัดประสิทธิภาพและความยั่งยืนของศูนย์ข้อมูล

PUE (Power Usage Effectiveness) ถือเป็นดัชนีมาตรฐานสากลที่สำคัญที่สุดในการวัดประสิทธิภาพการใช้พลังงานของศูนย์ข้อมูล (Data Center) โดย PUE คำนวณจากอัตราส่วนของพลังงานรวมทั้งหมดที่เข้าสู่ศูนย์ข้อมูล เทียบกับพลังงานที่ใช้โดยตรงในการประมวลผลของอุปกรณ์ไอที (Server, Storage, Networking) ค่า PUE ที่ได้จะบ่งบอกว่าในการประมวลผล 1 กิโลวัตต์ (kW) ของเซิร์ฟเวอร์นั้น ศูนย์ข้อมูลต้องใช้พลังงานรวมทั้งหมดเท่าใดเพื่อรักษาระบบสนับสนุนที่สำคัญ เช่น ระบบปรับอากาศ (Cooling System), ระบบไฟฟ้าสำรอง (UPS), และระบบอื่นๆ ให้สามารถทำงานได้ ตัวอย่างเช่น หาก PUE เท่ากับ 1.5 นั่นหมายความว่า ทุกๆ 1 kW ที่ใช้ในการประมวลผล จะต้องมีพลังงานอีก 0.5 kW ถูกใช้ไปกับระบบสนับสนุน

ประสิทธิภาพของศูนย์ข้อมูลในประเทศไทยมีความแตกต่างกันอย่างชัดเจน โดยศูนย์ข้อมูลที่ออกแบบตามมาตรฐานสากลและมีการบริหารจัดการพลังงานอย่างเข้มงวด สามารถทำค่า PUE ได้ดีที่สุดในปัจจุบันอยู่ที่ประมาณ 1.35 ซึ่งหมายความว่าใช้พลังงานสำรองเพียง 0.35 kW เพื่อรองรับการทำงานของเซิร์ฟเวอร์ 1 kW ในทางตรงกันข้าม ศูนย์ข้อมูลทั่วไป หรือศูนย์ข้อมูลที่ขาดการปรับปรุงประสิทธิภาพ มักมีค่า PUE สูงกว่า 2.0 (และอาจสูงถึง 2.5-3.0) ซึ่งหมายถึงการใช้พลังงานสำรองสูงถึง 2.0-2.5 kW เพื่อรันเซิร์ฟเวอร์เพียง 1 kW การสูญเสียพลังงานที่สูงเช่นนี้สะท้อนถึงการออกแบบระบบที่ไม่เหมาะสม โดยเฉพาะความไม่มีประสิทธิภาพของระบบปรับอากาศและระบบจ่ายไฟที่ทำให้ต้นทุนการดำเนินงาน (OPEX) เพิ่มสูงขึ้นอย่างมาก

นอกจากผลกระทบต่อต้นทุนแล้ว PUE ยังมีบทบาทสำคัญอย่างยิ่งต่อความยั่งยืนและการวัดผลกระทบต่อสิ่งแวดล้อม PUE เป็นตัวสะท้อนโดยตรงในการคำนวณ Carbon Emission (การปล่อยคาร์บอน) ขององค์กร เนื่องจากค่า PUE ที่สูงหมายถึงการใช้พลังงานไฟฟ้าโดยรวมที่สูงกว่าความจำเป็นอย่างมาก ซึ่งการผลิตพลังงานไฟฟ้าส่วนใหญ่ยังคงส่งผลให้เกิดการปล่อยก๊าซคาร์บอนไดออกไซด์ ดังนั้น การลดค่า PUE ให้ต่ำลงจึงไม่ใช่แค่การประหยัดค่าใช้จ่าย แต่ยังเป็นมาตรการเชิงกลยุทธ์ที่สำคัญในการบรรลุเป้าหมายด้านความยั่งยืน (ESG) และการก้าวสู่ Net Zero Emission ในอนาคต ทำให้ PUE เป็นตัวชี้วัดที่เชื่อมโยงประสิทธิภาพทางเทคนิคเข้ากับความรับผิดชอบต่อโลกได้อย่างลงตัว

AI และความจำเป็นของการระบายความร้อนด้วยของเหลว (Liquid Cooling)

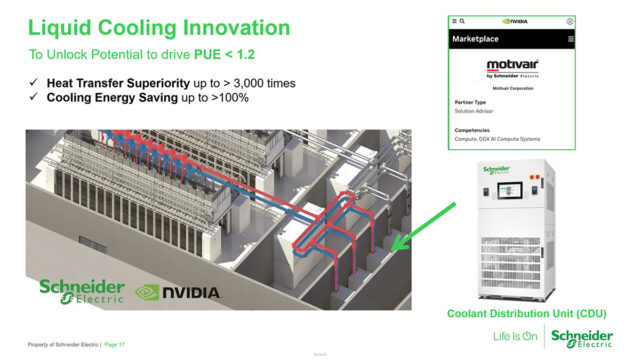

การปฏิวัติของปัญญาประดิษฐ์ (AI) ได้นำมาซึ่งการเปลี่ยนแปลงครั้งใหญ่ในโลกเทคโนโลยี โดยเฉพาะอย่างยิ่งในสถาปัตยกรรมของศูนย์ข้อมูล (Data Center) ซึ่งเป็นหัวใจสำคัญของการประมวลผลยุคใหม่ การประมวลผลสำหรับ AI นั้นต้องการพลังงานมหาศาล ซึ่งผลักดันให้ความหนาแน่นของพลังงานและความร้อนเพิ่มขึ้นอย่างก้าวกระโดด จนระบบระบายความร้อนแบบเดิมด้วยอากาศ (Air Cooling) ไม่สามารถตอบโจทย์ได้อีกต่อไป Liquid Cooling หรือ “การระบายความร้อนด้วยของเหลว” จึงกลายเป็นเทคโนโลยีที่เป็นทางออกและเป็นความจำเป็นเร่งด่วนในการขับเคลื่อนอนาคตของ “โรงงานผลิต AI” (AI Factory)

จุดเปลี่ยนของ Data Center มาจากการเติบโตของ AI นั้นผูกติดอยู่กับการพัฒนาอย่างก้าวกระโดดของหน่วยประมวลผลกราฟิก (GPU) ที่ออกแบบมาเพื่อรองรับงาน AI โดยเฉพาะ ซึ่งบริษัท NVIDIA เป็นผู้นำตลาดอย่างชัดเจน (ครองส่วนแบ่งมากกว่า 80% ของตลาด)

- ความหนาแน่นพลังงานที่พุ่งสูง: ในอดีต ตู้เซิร์ฟเวอร์ (Rack) ทั่วไปอาจใช้พลังงานเพียงประมาณ 3,000 วัตต์ต่อตู้ แต่ในยุค AI ปัจจุบัน เซิร์ฟเวอร์ที่ติดตั้งชิป AI ล่าสุด เช่น ชิป NVIDIA Rubin หรือสถาปัตยกรรมที่คล้ายกัน อาจต้องการกำลังไฟสูงถึง 132 กิโลวัตต์ต่อตู้ (kW/Rack) ซึ่งเป็นอัตราที่สูงขึ้นอย่างมหาศาล คิดเทียบเท่ากับการใช้พลังงานของ Data Center ขนาดใหญ่ 2-3 ห้องในอดีตมาอัดรวมกันในตู้เดียว

- สถาปัตยกรรมที่เปลี่ยนไป: การติดตั้งชิปที่หนาแน่นและใช้พลังงานสูงขนาดนี้ ทำให้โครงสร้างของ Data Center ต้องเปลี่ยนจากระบบระบายความร้อนด้วยลมแบบเดิม ไปสู่ระบบที่สามารถจัดการความร้อนที่เกิดขึ้นที่ตัวชิปได้โดยตรง

Liquid Cooling ทางออกเดียวสำหรับความร้อนระดับ Ultra-High Density

ความร้อนที่เกิดขึ้นจากชิปประมวลผล AI สมัยใหม่นั้นสูงเกินกว่าที่ระบบปรับอากาศมาตรฐานจะรับมือได้ ระบบปรับอากาศด้วยอากาศ (Air Cooling) ที่เคยเป็นกระแสหลักจึงกลายเป็นเทคโนโลยีในอดีต (Air Cooling is the Past)

Liquid Cooling คือเทคโนโลยีที่ใช้ของเหลว (เช่น น้ำ, สารหล่อเย็นพิเศษ) เป็นตัวกลางในการพาความร้อนออกจากชิปหรือส่วนประกอบที่สร้างความร้อนสูงโดยตรง ซึ่งแบ่งเป็นหลายประเภท เช่น Direct-to-Chip หรือ Immersion Cooling ข้อดีหลักๆ ของ Liquid Cooling มีดังนี้

- ประสิทธิภาพการระบายความร้อนที่เหนือกว่า: ของเหลวสามารถนำความร้อนออกจากแหล่งกำเนิดได้อย่างมีประสิทธิภาพสูงกว่าอากาศหลายสิบเท่า ทำให้สามารถรองรับความหนาแน่นของพลังงานที่สูงระดับ Ultra-High Density ได้อย่างต่อเนื่อง

- ประหยัดพลังงานด้านการทำความเย็น: Liquid Cooling ช่วยลดการพึ่งพาระบบปรับอากาศขนาดใหญ่แบบเดิมได้อย่างมหาศาล เป็นการเปิดประตูสู่การลดการใช้พลังงานทำความเย็นได้มากขึ้นถึง 4-5 เท่าจากระบบเดิมขึ้นอยู่กับการออกแบบและสภาพแวดล้อมของแต่ละศูนย์ข้อมูล

- การใช้พลังงานอย่างยั่งยืน (Sustainability): ปัจจุบันมีแนวโน้มการนำความร้อนที่ถูกพาออกมาด้วยของเหลวจากระบบ Liquid Cooling ใน Data Center ไปใช้ประโยชน์อื่น ๆ เช่น การทำน้ำร้อนสำหรับอาคารหรือระบบทำความร้อนอื่น ๆ ซึ่งแนวทางนี้เริ่มได้รับการพูดคุยและพัฒนาในอุตสาหกรรม Data Center เพื่อช่วยลดการใช้พลังงานสูญเปล่าและลดการปล่อยคาร์บอน โดยเฉพาะในประเทศที่มีมาตรฐานใหม่ที่เข้มงวด เช่น สิงคโปร์ ที่เริ่มผลักดันให้เกิดการนำความร้อนกลับมาใช้ใหม่ (Heat Reuse) เพื่อความยั่งยืนมากขึ้น

- ความเสี่ยงและความน่าเชื่อถือที่ต้องคำนึงถึง: แม้จะมีประสิทธิภาพสูง แต่ระบบ Liquid Cooling ก็มาพร้อมกับความท้าทายที่สำคัญ เนื่องจากชิป AI ที่มีราคาสูงมาก (หลายแสนถึงหลายล้านบาทต่อชิป) หากระบบน้ำหล่อเย็นเกิดความล้มเหลวเพียงเล็กน้อย เช่น ปั๊มหยุดทำงานหรือระบบรั่วซึม ในกรณีร้ายแรงชิปเหล่านี้อาจเสียหายได้ทันทีภายใน 10 วินาที ด้วยความร้อนที่พุ่งสูงขึ้นอย่างรวดเร็ว (Thermal Runaway) ดังนั้น ระบบควบคุมและตรวจสอบ (Control System) รวมถึงความน่าเชื่อถือของส่วนประกอบ (Reliability) จึงต้องอยู่ในระดับที่สูงสุด

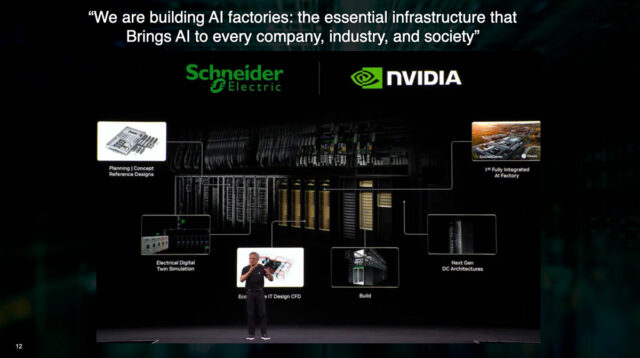

การเป็นพันธมิตรระดับโลก – Schneider Electric และ NVIDIA

เพื่อจัดการกับความท้าทายนี้และเร่งการนำเทคโนโลยี Liquid Cooling มาใช้งานใน “AI Factory” ที่ต้องการความพร้อมใช้งานและความน่าเชื่อถือสูงสุด บริษัทชั้นนำจึงได้จับมือเป็นพันธมิตรกัน

Schneider Electric ซึ่งเป็นผู้นำด้านการจัดการพลังงานและระบบอัตโนมัติ ได้รับการแต่งตั้งเป็น Certified Partner ร่วมกับ NVIDIA โดยมีเป้าหมายในการสร้าง AI Factory หรือโรงงานผลิต AI แบบครบวงจร ด้วยการนำเสนอ “สถาปัตยกรรมอ้างอิง (Reference Designs)” ที่รวมระบบจัดการพลังงานและควบคุมการระบายความร้อนด้วยของเหลวเข้าไว้ด้วยกันอย่างสมบูรณ์

ในประเทศไทย Schneider Electric เป็นหนึ่งในผู้ให้บริการด้าน Data Center เพียงไม่กี่รายที่ได้รับการรับรองจาก NVIDIA ในการส่งมอบโซลูชัน Liquid Cooling ที่มีมาตรฐานระดับโลก เพื่อให้มั่นใจว่าโครงสร้างพื้นฐาน AI ที่มีมูลค่าสูงของลูกค้าจะสามารถทำงานได้อย่างเต็มประสิทธิภาพ มีความยืดหยุ่น และมีความยั่งยืนสูงสุด

บทสรุปและการให้คำปรึกษา

การมาถึงของปัญญาประดิษฐ์ (AI) ไม่ได้เป็นเพียงการเปลี่ยนแปลงทางซอฟต์แวร์เท่านั้น แต่ยังเป็นการผลักดันให้เกิดการปฏิรูปครั้งใหญ่ในโครงสร้างพื้นฐานด้านฮาร์ดแวร์และ Data Center ทั้งระบบ โดยเฉพาะอย่างยิ่งความจำเป็นในการนำระบบระบายความร้อนด้วยของเหลว (Liquid Cooling) มาใช้เพื่อรองรับความหนาแน่นของพลังงานที่ไม่เคยมีมาก่อน

สำหรับองค์กรที่กำลังวางแผนหรือเริ่มดำเนินการใช้เทคโนโลยี AI ไม่ว่าจะเพื่อการฝึกฝนโมเดล (Training) หรือการประมวลผล (Inference) สิ่งสำคัญที่สุดคือการเตรียมความพร้อมด้านรากฐาน (Fundamental) ของระบบคอมพิวติ้ง เพื่อให้การเปลี่ยนผ่านสู่ยุค AI เป็นไปอย่างราบรื่น มีประสิทธิภาพ และยั่งยืน

แนวทางสำคัญ 3 ข้อในการเตรียม Data Center สำหรับยุค AI

องค์กรควรทำการประเมินและตัดสินใจเชิงกลยุทธ์ตามแนวทางต่อไปนี้

- ประเมินความพร้อม: องค์กรควรพิจารณาว่า Data Center เดิมสามารถรองรับเซิร์ฟเวอร์ AI ยุคใหม่ ที่มีความหนาแน่นของพลังงาน (Power Density) และ การรองรับ Liquid Cooling ได้หรือไม่

- การปรับปรุงหรือสร้างใหม่: หากการประเมินพบว่าโครงสร้างพื้นฐานเดิมไม่สามารถรองรับได้ การตัดสินใจเชิงกลยุทธ์ที่ต้องทำหากระบบเดิมไม่เพียงพอ ควรพิจารณาการปรับปรุง หรือใช้โซลูชันสำเร็จรูปที่พร้อมส่งมอบได้ทันที เช่น Micro Data Center, Prefabricated Data Center เป็นต้น

- ความยั่งยืน: การเลือกลงทุนต้องคำนึงถึง PUE และการลดคาร์บอน: Liquid Cooling ไม่เพียงแต่ช่วยประหยัดพลังงาน แต่ยังเป็นกุญแจสำคัญในการบรรลุเป้าหมาย PUE ที่ต่ำกว่า 1.2 และยังช่วยให้สามารถนำความร้อนกลับไปใช้ประโยชน์ (Heat Reuse) ซึ่งจะส่งผลให้องค์กรสามารถลดการปล่อยคาร์บอนในระยะยาวได้อย่างมีนัยสำคัญ

Schneider Electric พร้อมให้คำปรึกษาและทำการตรวจสอบอย่างเป็นระบบ (Audit) เพื่อประเมินความเหมาะสมของ Data Center ในองค์กร และนำเสนอโซลูชันเพื่อสนับสนุนการเปลี่ยนผ่านสู่ยุค AI อย่างยืดหยุ่นและยั่งยืน ศึกษาข้อมูลเพิ่มเติมเกี่ยวกับศูนย์ข้อมูล AI

รับชมวิดีโอเรื่อง “อิทธิพลของเทรนด์ AI กับการพลิกโฉมนวัตกรรม Data Center สู่การขับเคลื่อนอนาคตอย่างยืดหยุ่นและยั่งยืน” บรรยายโดย คุณศรัณยู ดาวนันท์ Pre-Sales Consultant Thailand, Laos & Myanmar จาก Schneider Electric ในงาน Tech Forum Bankok 2025 by TechTalkThai ได้ที่นี่

สนใจผลิตภัณฑ์ติดต่อผู้เชี่ยวชาญจาก Schneider Electric ได้ที่ ศูนย์บริการลูกค้าสัมพันธ์

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย