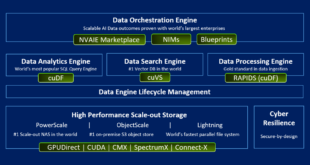

First Logic เป็นผู้นำด้านโซลูชันและบริการด้าน IT ที่มีประสบการณ์ยาวนานกว่า 20 ปี เรามุ่งมั่นที่จะเป็น Trusted Partner ขององค์กรไทยและนานาชาติ ในการบริหารจัดการข้อมูลและเทคโนโลยีดิจิทัลที่มีคุณภาพสูง ภายใต้มาตรฐานสากล ด้วยความเชี่ยวชาญทั้งด้าน Data Platform, Cloud Infrastructure, AI Solutions และ Enterprise Security บริษัทฯ ได้ร่วมมือกับพันธมิตรเทคโนโลยีระดับโลก เพื่อส่งมอบโซลูชันที่ตอบโจทย์ทั้งด้านประสิทธิภาพ ความปลอดภัย และความยั่งยืนทางธุรกิจ

ในฐานะผู้ริเริ่มนวัตกรรม First Logic ยังคงเดินหน้าพัฒนาโซลูชันที่ก้าวล้ำเพื่อตอบสนองความต้องการขององค์กรยุคใหม่ ล่าสุดเราได้เปิดตัว First Logic “AI Chatbot สำหรับองค์กร” ที่ออกแบบมาเพื่อยกระดับการทำงานและประสบการณ์ผู้ใช้งาน สู่การใช้งาน AI อย่างเป็นรูปธรรมและก้าวล้ำเทคโนโลยีอย่างมั่นคง

บทสรุปทั่วไปเกี่ยวกับ AI Chatbot

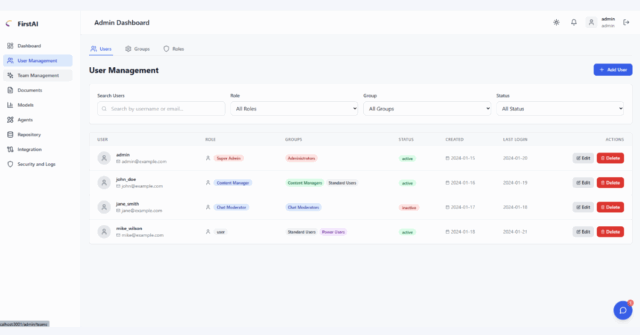

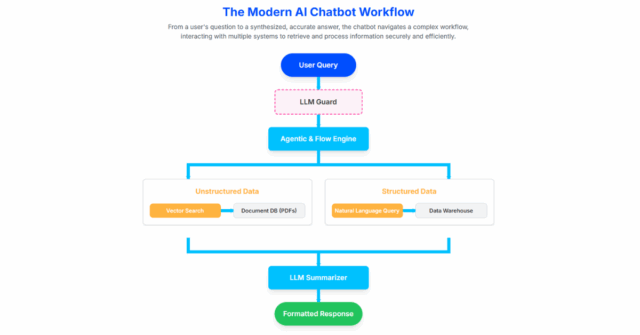

AI Chatbot สำหรับองค์กร ได้ก้าวข้ามขีดจำกัดของเครื่องมือตอบคำถามอัตโนมัติแบบดั้งเดิมไปสู่โซลูชันที่ชาญฉลาดและมีความซับซ้อนสูง คุณค่าของระบบนี้อยู่ที่ความสามารถในการเพิ่มประสิทธิภาพการดำเนินงาน ปลดล็อกข้อมูลเชิงลึกจากคลังข้อมูลขององค์กร และยกระดับประสบการณ์ของผู้ใช้งานทั้งพนักงานและลูกค้า ระบบได้รับการออกแบบให้เป็นสถาปัตยกรรมที่ครอบคลุม โดยประกอบด้วยโมดูลหลัก 6 ส่วน ได้แก่ คลังข้อมูลที่ปลอดภัย ระบบประมวลผล Agentic AI, API, การเลือกใช้โมเดล LLM ที่หลากหลาย ระบบ LLM Guardrail ที่แข็งแกร่ง และการควบคุมการเข้าถึงที่ยืดหยุ่น การบูรณาการขั้นสูงกับคลังข้อมูลขนาดใหญ่และคลังเอกสารขององค์กรผ่านเทคโนโลยีเฉพาะทาง เช่น Select AI ของ Oracle และ Vector Database เพื่อรองรับ Retrieval-Augmented Generation (RAG) ถือเป็นองค์ประกอบสำคัญของโซลูชันนี้

การที่องค์กรจะสามารถใช้ประโยชน์จากศักยภาพของ AI ได้อย่างแท้จริงนั้น จำเป็นต้องมีแนวทางแบบองค์รวมและมีสถาปัตยกรรมที่เชื่อถือได้ การนำไปใช้งานควรเป็นแบบค่อยเป็นค่อยไป โดยเน้นที่ความปลอดภัย ความสามารถในการขยายระบบในอนาคต และการสร้างมูลค่าในระยะยาวก่อนที่จะเพิ่มฟังก์ชันการทำงานขั้นสูงอื่นๆ

วิวัฒนาการของ Conversational AI ในโลกธุรกิจ

ในอดีต Chatbot เป็นเพียงระบบที่อาศัยกฎเกณฑ์และคำหลักหรือคำค้นที่กำหนดไว้ล่วงหน้าเพื่อตอบคำถามพื้นฐาน แต่ในปัจจุบัน ด้วยความก้าวหน้าของ AI technology (Large Language Models: LLM) ทำให้ Chatbot สำหรับองค์กรได้พัฒนาไปสู่เครื่องมืออัจฉริยะที่สามารถทำงานหลายขั้นตอนและซับซ้อน AI Chatbot สมัยใหม่จึงไม่ได้เป็นแค่เครื่องมือสำหรับตอบคำถามที่พบบ่อย (FAQ) อีกต่อไป แต่ยังทำหน้าที่เป็นผู้ช่วยอัจฉริยะที่สามารถจัดการงานที่ซับซ้อนและหลากหลายได้

ระบบนี้มุ่งเน้นไปที่การนำเสนอ Model แบบ Hybrid ที่ผสมผสานระหว่าง LLM ที่ใช้งานทั่วไปกับความต้องการเฉพาะขององค์กร โดยให้ความสำคัญกับการตอบคำถามที่สำคัญเกี่ยวกับข้อมูลขององค์กร ข้อมูลความปลอดภัย การนำเสนอโซลูชันนี้มีเป้าหมายเพื่อนำพาองค์กรจากระบบเดิม ไปสู่ AI Application และปรับให้เหมาะสมกับธุรกิจโดยเฉพาะ

ส่วนประกอบพื้นฐานที่สำคัญของ Enterprise Chat

- Secure Data repository: หัวใจสำคัญของความน่าเชื่อถือ

ข้อกำหนดประการแรกและสำคัญที่สุดสำหรับ AI Chatbot ระดับองค์กรคือการมีคลังข้อมูลที่ปลอดภัยสำหรับจัดเก็บข้อมูลองค์กรที่มีความละเอียดอ่อน การใช้ LLM สาธารณะที่ประมวลผลข้อมูลบนเซิร์ฟเวอร์ภายนอกนั้นมีความเสี่ยงสูงต่อการรั่วไหลของข้อมูล ดังนั้น โซลูชันระดับองค์กรจึงต้องทำงานในสภาพแวดล้อมที่เป็นส่วนตัว ไม่ว่าจะเป็นภายในองค์กรหรือบนคลาวด์ที่ปลอดภัยเท่านั้น

เพื่อให้มั่นใจในความปลอดภัยสูงสุด ระบบต้องมีการเข้ารหัสข้อมูลทั้งขณะส่งผ่านและขณะจัดเก็บโดยใช้ Protocol ที่เชื่อถือได้ เช่น AES (Advanced Encryption Standard) นอกจากนี้ ระบบยังต้องมีการควบคุมการเข้าถึงที่รัดกุม เช่น การใช้ Role-Based Access Control (RBAC) เพื่อจำกัดการเข้าถึงข้อมูลที่ละเอียดอ่อนให้เฉพาะบุคลากรที่ได้รับอนุญาตเท่านั้น การตรวจสอบความปลอดภัยเป็นประจำถือเป็นสิ่งจำเป็นเพื่อให้แน่ใจว่าระบบและการทำงานของ Chatbot เป็นไปตามมาตรฐาน

การพิจารณาในเชิงสถาปัตยกรรมชี้ให้เห็นว่า คลังข้อมูลนี้ไม่ได้เป็นเพียงฐานข้อมูลสำหรับจัดเก็บข้อมูล แต่เป็นโครงสร้างพื้นฐานข้อมูลทั้งหมดที่ขับเคลื่อนระบบ AI ทั้งหมด การรักษาความปลอดภัยของข้อมูลในคลังนี้เป็นเงื่อนไขที่จำเป็นสำหรับฟังก์ชันการทำงานขั้นสูงอื่นๆ เช่น การใช้ RAG (Retrieval-Augmented Generation) กับเอกสารที่เป็นกรรมสิทธิ์ขององค์กร หรือการที่ Agentic AI จะทำงานกับข้อมูลภายในได้อย่างปลอดภัย หากไม่มีฐานข้อมูลที่เป็นส่วนตัวและเชื่อถือได้แล้ว คุณสมบัติเหล่านี้ย่อมไม่สามารถทำได้อย่างปลอดภัย หรือมีความเสี่ยงที่ยอมรับไม่ได้ (Non-Acceptable Risks) ดังนั้น จึงเปลี่ยนจากการสร้าง “Chatbot” เป็นการสร้าง “แพลตฟอร์มข้อมูล AI สำหรับองค์กรที่ปลอดภัยพร้อม Interface ของการสนทนา”

2. ก้าวล้ำด้วย Agentic AI: เหนือกว่า Chatbot แบบดั้งเดิม

Chatbot แบบดั้งเดิมเป็นระบบที่ตอบสนองตามกฎที่กำหนดไว้ล่วงหน้าหรือการประมวลผลภาษา (NLP) อย่างง่าย ในทางกลับกัน Chatbot ที่ขับเคลื่อนด้วย Agentic AI เป็นระบบอัจฉริยะที่สามารถทำงานได้อย่างอิสระ แสดงความคิดริเริ่ม และดำเนินงานหลายขั้นตอนได้อย่างเป็นอิสระโดยไม่ต้องมีการควบคุมจากมนุษย์อย่างต่อเนื่อง ระบบเหล่านี้ถูกออกแบบมาเพื่อจัดการกับ “คำถามที่ซับซ้อน” และ “Workflow ที่ต้องการความยืดหยุ่น”

ความสามารถของ Agentic AI ประกอบด้วย:

- การตัดสินใจโดยพิจารณาจากบริบท: ระบบ Agentic สามารถวิเคราะห์ประวัติการสนทนาและแหล่งข้อมูลภายนอกเพื่อประกอบการตัดสินใจ

- การวางแผนตามเป้าหมาย: ระบบสามารถแบ่งคำขอที่ซับซ้อนออกเป็นงานย่อยที่จัดการได้และคงเป้าหมายไว้ตลอดการโต้ตอบหลายครั้ง

- การทำงานร่วมกันของ Multi-Agent: สำหรับปัญหาที่มีความซับซ้อนสูง ระบบสามารถให้ Agent เฉพาะทางหลายตัวทำงานร่วมกันเพื่อจัดการกับแต่ละด้านของงาน

- การใช้งานในโลกจริง: ตัวอย่างการใช้งานได้แก่ การสนับสนุนลูกค้าอัจฉริยะที่คาดการณ์ความต้องการของผู้ใช้, HR Chatbot ที่ตอบคำถามพนักงาน และ Agent ฝ่ายขายที่ทำหน้าที่ดูแลลูกค้าเป้าหมายและการติดตามผล

3. Integration: การรองรับ API

API (Application Programming Interface) ทำหน้าที่เป็น software layer ที่ช่วยให้ Chatbot สามารถสื่อสารกับแอปพลิเคชันและแหล่งข้อมูลอื่นๆ ในองค์กรได้ การเชื่อมต่อนี้จำเป็นอย่างยิ่งสำหรับโซลูชันที่ต้องการความสามารถในการขยายระบบในอนาคตและเข้าถึงได้หลายช่องทาง

ประโยชน์ของสถาปัตยกรรมแบบ API-First ได้แก่:

- การเข้าถึงได้หลายช่องทาง: Backend ของ Chatbot เพียงตัวเดียวสามารถนำไปใช้งานได้หลากหลายช่องทาง ไม่ว่าจะเป็นเว็บไซต์ แอปพลิเคชันบนมือถือ โซเชียลมีเดีย หรือแพลตฟอร์มขององค์กร เช่น Slack, Line OA หรือ Google Chat เป็นต้น

- การเพิ่มฟังก์ชันการทำงาน: API ช่วยให้ Chatbot สามารถดำเนินงานทางธุรกิจได้จริง เช่น การดึงประวัติการสั่งซื้อจากระบบ CRM, การประมวลผลการชำระเงิน หรือการนัดหมาย

4. การเลือกใช้ LLM: แนวทางแบบ multi-model

การเลือก LLM เป็นการตัดสินใจที่สำคัญ โดยในตลาดมีตัวเลือกมากมาย ตั้งแต่ OpenAI, Google Gemini ไปจนถึงโมเดลโอเพนซอร์สที่ยืดหยุ่น Llama, Mistral และโมเดลที่ทำงานแบบ Local machine

การมีโมเดล LLM ให้เลือกที่หลากหลายไม่ใช่แค่การมีตัวเลือกมากขึ้น แต่เป็นโอกาสในการสร้าง “Orchestration process” ซึ่งเป็นข้อได้เปรียบในการแข่งขัน การสร้างระบบที่มีความยืดหยุ่นและรองรับอนาคตได้โดยไม่ถูกผูกติดกับผู้ให้บริการรายใดรายหนึ่ง

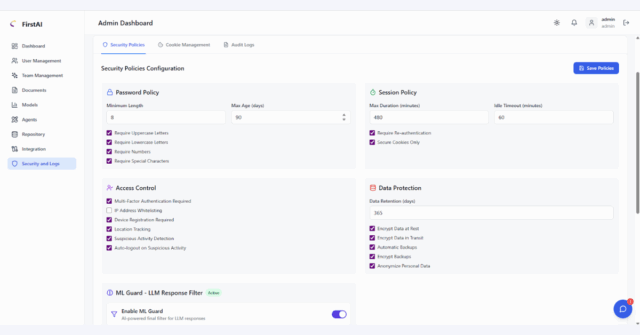

5. ความสำคัญของความปลอดภัย: การใช้ LLM Guardrails

LLM Guardrails คือกฎและตัวกรองที่กำหนดไว้ล่วงหน้าเพื่อปกป้องระบบจากช่องโหว่ต่างๆ เช่น การรั่วไหลของข้อมูล, ความลำเอียง, Hallucination (การสร้างข้อมูลที่ผิดพลาด), และการป้อนข้อมูลที่เป็นอันตราย ถือเป็นแนวป้องกันที่จำเป็นอย่างยิ่งในการใช้งานจริง

Guardrails แบ่งออกเป็นสองประเภท:

- Input Guardrails: ถูกนำมาใช้ก่อนที่ LLM จะประมวลผลคำขอ โดยจะตรวจจับและบล็อกการป้อนข้อมูลที่เป็นอันตราย เช่น “Prompt Injection” สิ่งนี้จะป้องกันผู้ใช้งานจากการหลอกล่อให้ LLM เปิดเผยข้อมูลที่ละเอียดอ่อนหรือสร้างเนื้อหาที่ไม่เหมาะสม

- Output Guardrails: ทำหน้าที่ประเมินการตอบสนองที่สร้างขึ้น เพื่อให้แน่ใจว่าปลอดภัย, เกี่ยวข้อง, และปราศจากเนื้อหาที่ไม่เหมาะสม ซึ่งรวมถึงการตรวจสอบภาษาที่ไม่เหมาะสม, ความไม่ถูกต้องของข้อเท็จจริง หรือ Hallucination

การพิจารณาเชิงลึกแสดงให้เห็นว่า Guardrails ไม่ใช่แค่ตัวกรองธรรมดา แต่เป็น “เทคโนโลยีการป้องกันหลัก” ที่มีลักษณะเชิงรุกและเป็นแนวทางปฏิบัติ บทบาทของมันได้เปลี่ยนจากการ “ดูแลเนื้อหา” (Content Moderation) ไปสู่การ “กำกับดูแลเชิงรุก” (Proactive Governance) ที่เป็นกลยุทธ์ของการบริหารความเสี่ยง

การเพิ่มความชาญฉลาดด้วยการบูรณาการข้อมูล

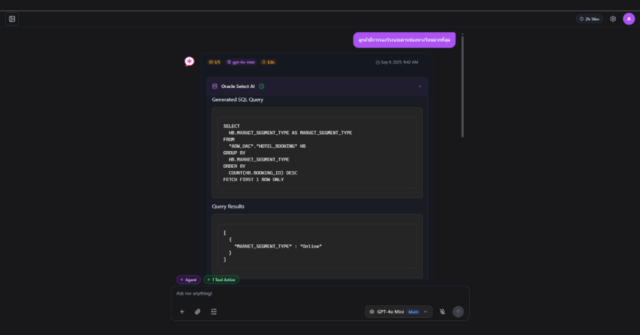

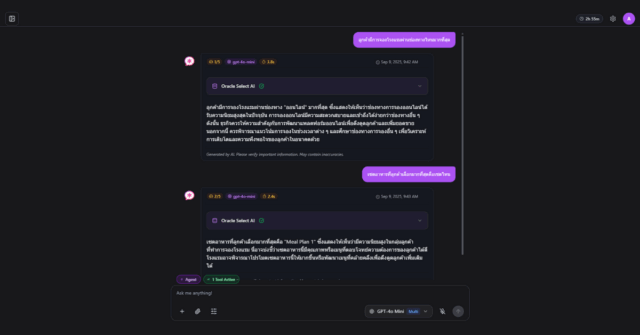

- การเชื่อมต่อกับ Data Warehouse: พลังของ Select AI

ความท้าทายที่สำคัญสำหรับองค์กรคือการทำให้ผู้ใช้งานสามารถเข้าถึงข้อมูลในฐานข้อมูลภายในองค์กรได้อย่างง่ายดาย Select AI ของ Oracle Autonomous Database ได้เข้ามาแก้ไขปัญหานี้ด้วยการแปลคำสั่งภาษาทั่วไป ให้ไปเป็นคำสั่ง SQL ทำให้ผู้ใช้ที่ไม่มีความเชี่ยวชาญด้านเทคนิคสามารถโต้ตอบกับชุดข้อมูลขนาดใหญ่ขององค์กรได้

การเชื่อมต่อกับฐานข้อมูลขององค์กร ผ่านคุณสมบัติอย่าง Select AI ทำให้ Chatbot สามารถให้ข้อมูลเชิงลึกทางธุรกิจแบบ Real-time และเป็นไดนามิกได้ จากเดิมที่เป็นเพียง Chatbot ที่ให้คำตอบจากฐานความรู้คงที่ กลายเป็นผู้ช่วยนักวิเคราะห์ข้อมูล ผู้ใช้สามารถถามคำถามเช่น “รายได้จากการขายในไตรมาสที่ 3 ในภูมิภาคตะวันออกเฉียงใต้ของเราเป็นเท่าไหร่?” และ Chatbot ก็จะสร้างและรันคำสั่ง SQL เพื่อดึงคำตอบ วิเคราะห์ข้อมูลแบบ Real-time นี้ถือเป็นก้าวกระโดดที่สำคัญของ Chatbot สำหรับองค์กร

2. การปลดล็อกข้อมูล Unstructured: RAG กับ Vector Database

องค์ความรู้จำนวนมหาศาลขององค์กรมักอยู่ในรูปแบบที่ไม่มีโครงสร้าง เช่น ไฟล์ PDF, รายงานภายใน และอีเมล LLM ทั่วไปไม่สามารถเข้าถึงข้อมูลที่เป็นส่วนตัวนี้ได้ ซึ่งเป็นช่องว่างสำคัญที่มีในระบบ

โซลูชัน Retrieval-Augmented Generation (RAG) เข้ามาแก้ไขข้อจำกัดนี้กระบวนการนี้ประกอบด้วย:

- การนำเข้าข้อมูลและการแบ่งส่วน: เอกสารที่ไม่มีโครงสร้าง (เช่น PDF) จะถูกนำเข้าและแบ่งออกเป็นส่วนย่อยๆ ของข้อความ จากนั้นแปลงเป็น “Vector Embedding”

- การจัดเก็บ Vector: Vector เหล่านี้ซึ่งเป็นตัวแทนของความหมายเชิง Semantic ของข้อความ จะถูกจัดเก็บในฐานข้อมูลเฉพาะทางที่เรียกว่า “Vector Database”

- การค้นหาเชิง Semantic: เมื่อผู้ใช้ถามคำถาม คำถามนั้นจะถูกแปลงเป็น Vector เช่นกัน จากนั้นระบบจะทำการ “ค้นหาความคล้ายคลึง แบบกำหนดความละเอียดได้” (Similarity Search) เพื่อค้นหาส่วนที่เกี่ยวข้องที่สุดใน Vector Database

- การเพิ่มข้อมูลและการสร้างคำตอบ: ส่วนของเอกสารที่ถูกดึงมาจะถูกนำไป “เพิ่ม” ใน Prompt ดั้งเดิมที่ส่งไปยัง LLM จากนั้น LLM จะสร้างคำตอบที่อิงอยู่กับข้อมูลเชิงข้อเท็จจริงที่ให้มา

บทสรุป

“AI Chatbot สำหรับองค์กร” ที่ชาญฉลาดคือการรวมกันของเทคโนโลยีที่ซับซ้อนหลายประการ ไม่ใช่ผลิตภัณฑ์เดียว แต่เป็นระบบที่มีความซับซ้อนและเชื่อมโยงถึงกัน โดยที่ความปลอดภัย การบูรณาการข้อมูล และโมเดล AI ขั้นสูง ทำงานร่วมกันเพื่อปลดล็อกมูลค่าที่ไม่เคยมีมาก่อน

คำแนะนำสำหรับแผนการนำไปใช้งานแบบค่อยเป็นค่อยไป:

- เฟส 1: วางรากฐานก่อน จัดลำดับความสำคัญของการสร้างคลังข้อมูลที่เป็นส่วนตัวและปลอดภัย พร้อมกับ API ที่รองรับหลายช่องทาง

- เฟส 2: Unlocked องค์ความรู้ โดยนำ RAG และ Vector Database มาใช้งานสำหรับข้อมูลที่ไม่มีโครงสร้าง เพื่อเพิ่มประโยชน์ของ Chatbot ได้ทันทีโดยใช้เอกสารภายในองค์กร

- เฟส 3: เพิ่มความชาญฉลาดให้กับระบบ บูรณาการกับแหล่งข้อมูลเชิงโครงสร้างโดยใช้คุณสมบัติอย่าง Select AI ของ Oracle เพื่อเปิดใช้งานความสามารถด้านธุรกิจอัจฉริยะ

- เฟส 4: ยกระดับการทำงาน นำ Agentic AI เข้ามาใช้เพื่อทำงานใน Workflow ที่ซับซ้อนและให้บริการเชิงรุกและมุ่งเน้นเป้าหมาย

- เฟส 5: เสริมความปลอดภัยและเพิ่มประสิทธิภาพ ตรวจสอบและปรับปรุงระบบ LLM Guardrail และกลยุทธ์การประสานงานแบบ Multi-model อย่างต่อเนื่อง เพื่อให้ได้ประสิทธิภาพสูงสุด ต้นทุนที่เหมาะสม และความปลอดภัยสูงสุด

สนใจข้อมูลเพิ่มเติม ติดต่อได้ที่ 🎯

📧 Email : contact@firstlogic.co.th

🌍 Website : www.firstlogic.co.th

📌Facebook Page : https://www.facebook.com/FirstLogicTH/

🚩Linkedin Page : www.linkedin.com/in/first-logic-company-limited-875360262

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย

TechTalkThai ศูนย์รวมข่าว Enterprise IT ออนไลน์แห่งแรกในประเทศไทย